Net Logo : Agenci i Ķrodowisko

Dawno, dawno temu … w przyszģoķci

Sztuczna inteligencja to zģoŋony, a jednoczeķnie intrygujący temat. Gdybyķmy posģuŋyli się analogią do opisu badaņ Sztucznej Inteligencji, moglibyķmy ewentualnie porównaæ do krajobrazu, w którym z biegiem czasu ksztaģtuje się i zmienia ksztaģt czģowieka (aby podkreķliæ jego ciągģą ewolucję). Lub moglibyķmy obserwowaæ piaski pustyni, które przesuwają się wraz z wiatrem (aby wskazaæ na jego dynamiczny charakter). Jeszcze inna analogia moŋe dotyczyæ efemerycznej natury chmur, kontrolowanych przez przewaŋające wiatry, których substancji nie da się jednak uchwyciæ. Te analogie są bogate w metaforę i są bliskie prawdy pod innymi względami. Język naturalny jest substancją, z którą piszemy, a metafory i analogie są waŋnymi urządzeniami, które my, jako uŋytkownicy i producenci języka sami, jesteķmy w stanie zrozumieæ i stworzyæ. To jedno z największych wyzwaņ w dziedzinie sztucznej inteligencji. Inne wyzwania obejmowaģy pokonanie mistrza ķwiata w szachach, prowadzenie samochodu w ķrodku miasta, wykonywanie operacji chirurgicznej, pisanie zabawnych historii i tak dalej; Sztuczna inteligencja to tak ciekawy temat.

Podobnie jak wspomniane wyŋej przesuwane piaski, przez wiele lat dokonywano wielu waŋnych zmian paradygmatu w Sztucznej Inteligencji. Tradycyjny lub klasyczny paradygmat sztucznej inteligencji (podejķcie "symboliczne") polega na projektowaniu inteligentnych systemów opartych na symbolach, stosując metaforę przetwarzania informacji. Przeciwny paradygmat sztucznej inteligencji (podejķcie "sub-symboliczne" lub onnektyczny) zakģada, inteligentne zachowanie w sposób nie symboliczny, przyjmujący ucieleķnione podejķcie behawiorystyczne. Takie podejķcie kģadzie nacisk na znaczenie fizycznego uziemienia, ucieleķnienia i usytuowania, jak podkreķlają prace Brooksa w dziedzinie robotyki i Lakoffa i Johnsona w dziedzinie językoznawstwa. Gģównym podejķciem przyjętym przez nas będzie gģównie to drugie podejķcie, ale zostanie równieŋ opisane poķrednie podģoŋe w oparciu o prace Gärdenforsa, które ilustrują, w jaki sposób systemy symboliczne mogą powstaæ w wyniku zastosowania ukrytego podliczbowego podejķcia. . Postęp wiedzy szybko się rozwija, szczególnie w dziedzinie sztucznej inteligencji. Co waŋne, istnieje równieŋ nowe pokolenie ludzi , którzy poszukują tej wiedzy - tych, dla których Internet i gry komputerowe istnieją juŋ od dzieciņstwa. Ci ludzie mają bardzo odmienną perspektywę i bardzo odmienny zestaw zainteresowaņ niŋ starsi .Na przykģad, nigdy nie sģyszeli nawet o grach planszowych takich, dlatego będą mieli trudnoķci z zrozumieniem znaczenia algorytmów wyszukiwania w tym kontekķcie. Kiedy jednak uczą się tych samych algorytmów wyszukiwania w kontekķcie gier komputerowych lub przeszukiwania sieci, szybko pojmują te pojęcia i przenoszą je do miejsca, w którym ty, jako ich nauczyciel, nie mógģbyķ odejķæ bez ich pomocy. To, czego potrzebuje sztuczna inteligencja, to "odrodzenie wyobražni", jak obecny trend w serialach science-fiction - opowiedzenie tej samej historii, ale z róŋnymi aktorami i róŋnymi akcentami, aby zaangaŋowaæ nowoczesną publicznoķæ.

AI i Języki Programowania : NetLogo

Przez lata proponowano kilka języków programowania, które dobrze pasują do budowy systemów komputerowych dla sztucznej inteligencji. Historycznie, najbardziej znanymi językami programowania AI byģy Lisp i Prolog

Lisp (i powiązane dialekty, takie jak Common Lisp i Scheme) ma doskonaģe moŋliwoķci przetwarzania list i symboli, z moŋliwoķcią ģatwej zamiany kodu i danych, i byģ szeroko wykorzystywany do programowania AI, ale jego dziwna skģadnia z zagnieŋdŋonym nawiasem czyni go trudnym język do opanowania, a jego uŋycie zmniejszyģo się od lat dziewięædziesiątych.

Prolog, logiczny język programowania, staģ się językiem wybranym w 1982 roku dla ostatecznie nieudanego japoņskiego projektu piątej generacji, który miaģ na celu stworzenie superkomputera z uŋytecznymi moŋliwoķciami sztucznej inteligencji.

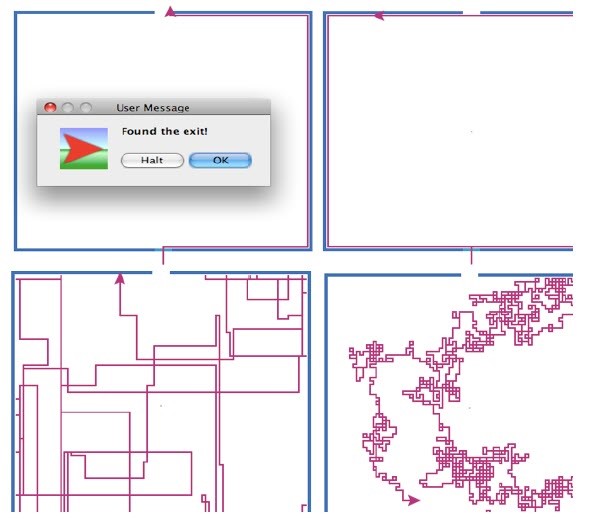

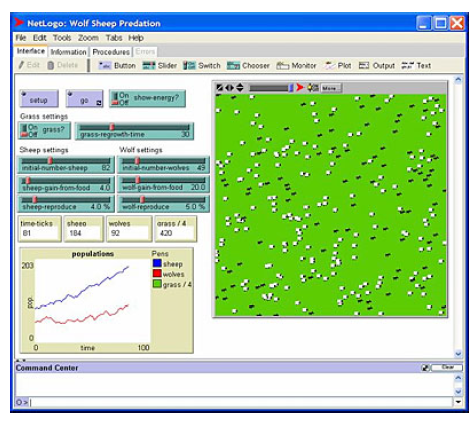

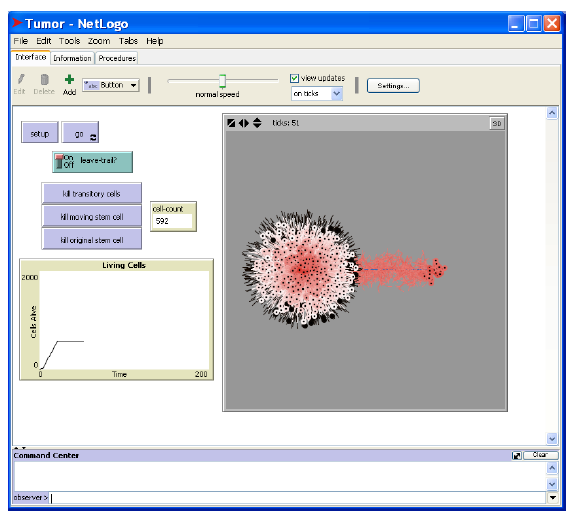

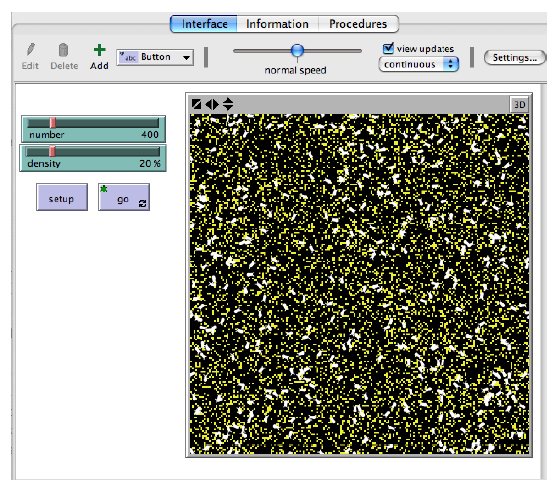

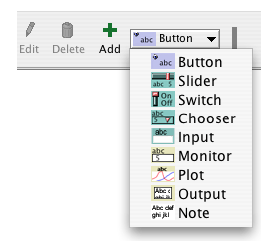

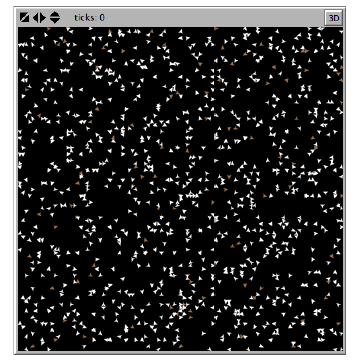

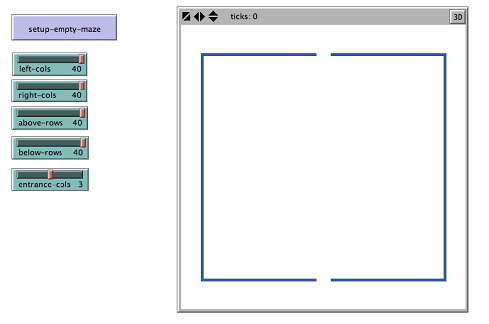

NetLogo ( stworzony przez Wilensky'ego w 1999) zostaģ wybrany do dostarczania próbek kodu w naszych przykģadach, aby zilustrowaæ, w jaki sposób moŋna zaimplementowaæ algorytmy. Przyczyny dostarczenia rzeczywistego kodu są takie same jak przedstawione przez Segaran w jego ksiąŋce o zbiorowej inteligencji - ŋe jest to bardziej uŋyteczne i "prawdopodobnie ģatwiejsze do naķladowania", z nadzieją, ŋe takie podejķcie doprowadzi do pewnego rodzaju nowego "kompromisu" w ksiąŋkach technicznych, które "wprowadzają czytelników delikatnie w algorytmy", pokazując im dziaģający kod. Alternatywne opisy, takie jak pseudo-kod, wydają się byæ niejasne i mylące oraz mogą ukrywaæ bģędy, które stają się widoczne dopiero na etapie implementacji. Co waŋniejsze, rzeczywisty kod moŋna ģatwo uruchomiæ, aby zobaczyæ, jak dziaģa i szybko się zmieniģ, jeķli czytelnik chce dokonaæ ulepszeņ bez potrzeby pisania kodu od zera.

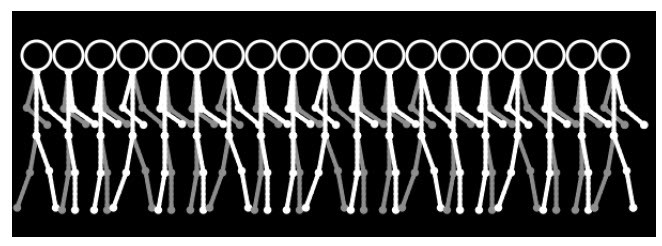

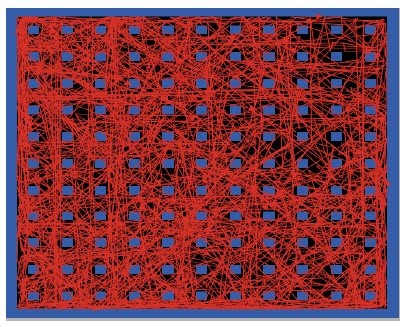

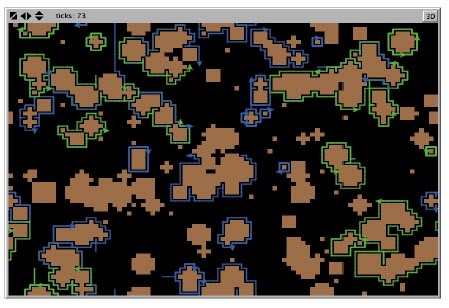

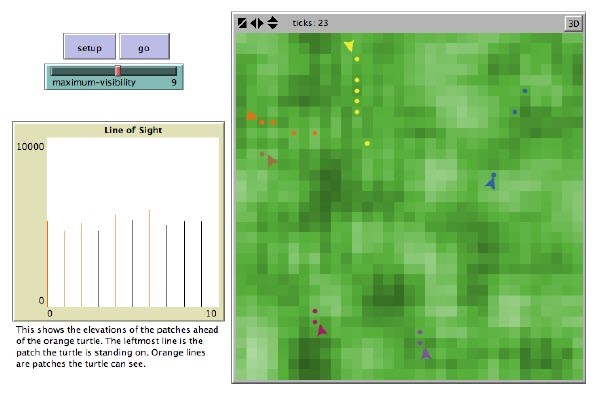

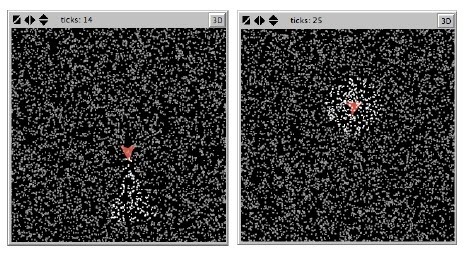

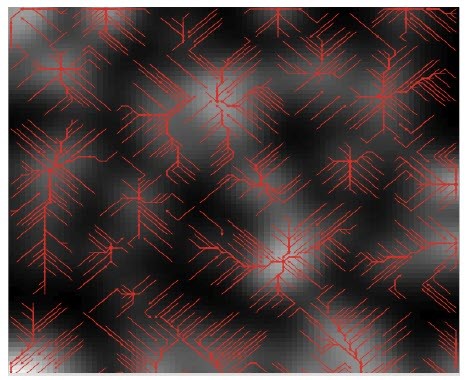

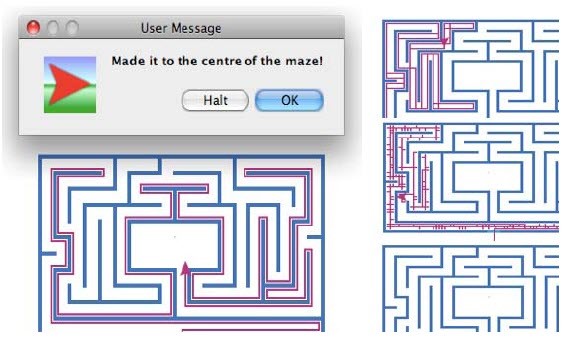

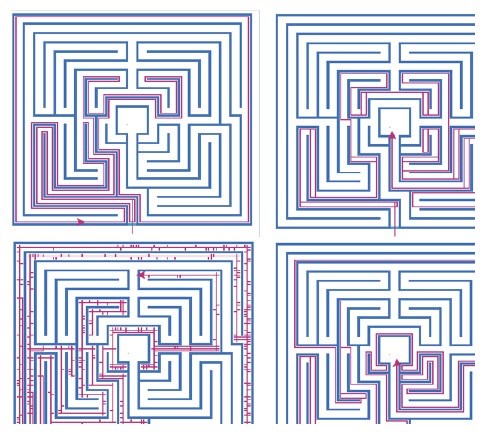

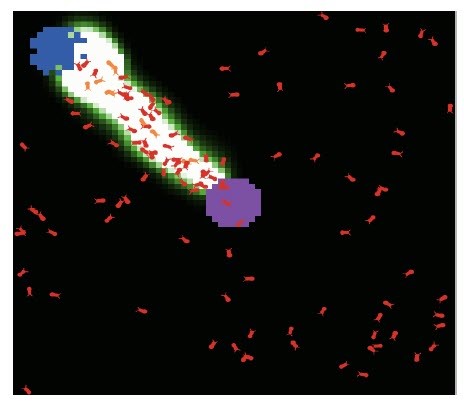

NetLogo (potęŋny dialekt Logo) to język programowania z dominującymi atutami agenta. Posiada wyjątkowe moŋliwoķci, które sprawiają, ŋe jest niezwykle potęŋny do tworzenia i wizualizacji symulacji systemów wieloagentowych i jest uŋyteczny do podkreķlania róŋnych problemów związanych z ich implementacją, która moŋe zaæmiģaby bardziej tradycyjny język, taki jak Java czy C / C ++. NetLogo jest implementowany w Javie i ma bardzo zwarty i czytelny kod, dlatego jest idealny do demonstrowania skomplikowanych pomysģów w zwięzģy sposób. Ponadto pozwala uŋytkownikom rozszerzyæ język, pisząc nowe polecenia i reportery w Javie. W rzeczywistoķci ŋaden język programowania nie jest odpowiedni do wdroŋenia peģnego zakresu systemów komputerowych wymaganych do sztucznej inteligencji. Rzeczywiķcie, nie istnieje jeszcze jeden język programowania, który sprosta zadaniu. W przypadku "sztucznej inteligencji opartej na zachowaniu" (i pokrewnych dziedzinach, takich jak ucieleķniona kognitywistyka), wymagany jest język w peģni zorientowany na agenta, który ma bogactwo języka Java, ale jest zorientowana na agentów prostota języka, takiego jak NetLogo.

Krótkie Wprowadzenie

1.1 Czym jest "Sztuczna inteligencja"?

Sztuczna inteligencja jest nauką, jak budowaæ systemy komputerowe, które wykazują inteligencję w pewien sposób. Sztuczna inteligencja przyniosģa wiele przeģomów w informatyce - wiele podstawowych tematów badawczych w dzisiejszej nauce informatyki rozwinęģo się z badaņ nad sztuczną inteligencją; na przykģad sieci neuronowe, obliczenia ewolucyjne, uczenie maszynowe, przetwarzanie języka naturalnego, programowanie obiektowe, aby wymieniæ tylko kilka. W wielu przypadkach gģównym tematem tych badaņ nie jest juŋ rozwój sztucznej inteligencji, staģy się dyscypliną samą w sobie, a w niektórych przypadkach nie są juŋ uwaŋane za związane z AI. Sama AI kontynuuje podróŋ w poszukiwaniu dalszych spostrzeŋeņ, które doprowadzą do kluczowych przeģomów, które są nadal potrzebne. Byæ moŋe czytelnik moŋe byæ tym, który dostarczy jeden lub więcej przeģomowych odkryæ w przyszģoķci. Jednym z najbardziej ekscytujących aspektów sztucznej inteligencji jest to, ŋe wciąŋ istnieje wiele pomysģów do wymyķlenia, wiele dróg wciąŋ jest do odkrycia. Sztuczna inteligencja jest ekscytującym i dynamicznym obszarem badaņ. Szybko się zmienia, a badania na przestrzeni lat rozwijają i wciąŋ rozwijają wiele genialnych i interesujących pomysģów. Jednak musimy jeszcze osiągnąæ ostateczny cel sztucznej inteligencji. Wiele osób kwestionuje, czy kiedykolwiek osiągniemy to z powodów wymienionych poniŋej. Dlatego kaŋdy, kto studiuje lub bada sztuczną inteligencję, powinien zachowaæ otwarty umysģ na temat stosownoķci przedstawionych pomysģów. Powinni zawsze zastanawiaæ się, jak dobrze dziaģają te pomysģy, pytając, czy istnieją lepsze pomysģy lub lepsze podejķcia

1.2 Ķcieŋki do sztucznej inteligencji

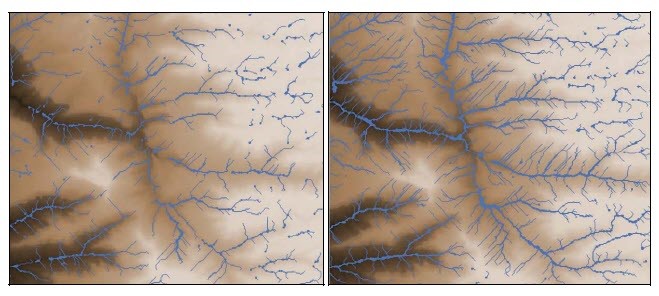

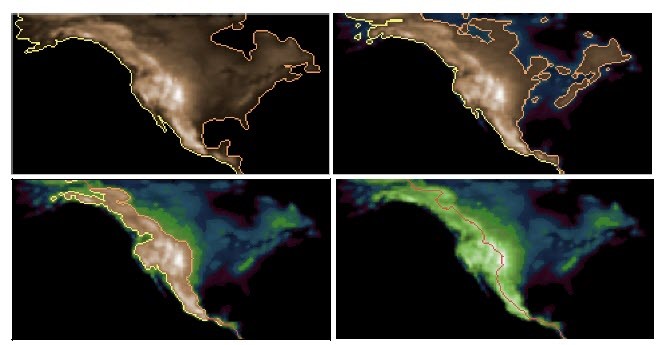

Zróbmy analogię między badaniami nad sztuczną inteligencją a eksploracją niezbadanego terytorium; na przykģad wyobražmy sobie czas, kiedy kontynent póģnocnoamerykaņski byģ eksplorowany po raz pierwszy, a mapy nie byģy dostępne. Pierwsi odkrywcy nie mieli wiedzy o terenie, który badali; ruszają w jednym kierunku, aby dowiedzieæ się, co tam jest. W tym procesie mogą zapisywaæ to, co odkryli, pisząc w dziennikach lub rysując mapy. Pomogģoby to póžniejszym odkrywcom, ale dla większoķci wczesnych odkrywców teren byģ zasadniczo nieznany, chyba ŋe mieli trzymaæ się tych samych ķcieŋek, z których korzystali pierwsi odkrywcy. Obecnie badania nad sztuczną inteligencją wciąŋ znajdują się na wczesnym etapie eksploracji. Większoķæ terenu do zbadania jest wciąŋ nieznana. Eksplorator sztucznej inteligencji ma wiele moŋliwych ķcieŋek, które mogą odkrywaæ w poszukiwaniu metod, które mogą prowadziæ do inteligencji maszyny. Niektóre z tych ķcieŋek będą ģatwe i prowadzą do ŋyznych ziem; inne doprowadzą do górzystego i trudnego terenu lub do pustyņ. Niektóre ķcieŋki mogą prowadziæ do nieprzebytych klifów. Bez względu na to, jaką konkretną ķcieŋkę stwarza badaczom sztucznej inteligencji, poszukiwania będą ekscytujące, poniewaŋ w naszej ludzkiej naturze chcemy odkrywaæ i znajdowaæ rzeczy. Moŋemy spojrzeæ na ķcieŋki wybrane przez dawnych "odkrywców" w Sztucznej Inteligencji. Na przykģad analiza pytania "Czy komputery potrafią myķleæ?" doprowadziģa do wielu intensywnych debat w przeszģoķci, które zaowocowaģy róŋnymi ķcieŋkami podjętymi przez badaczy sztucznej inteligencji. Nilsson zwróciģ uwagę, ŋe moŋemy podkreķliæ kaŋde sģowo po kolei, aby przedstawiæ inne spojrzenie na to pytanie. (Uŋyģ sģowa "maszyny", ale zamiast tego uŋyjemy sģowa "komputery"). Wež pierwsze sģowo - "Czy komputery mogą myķleæ?" Czy mamy na myķli: "Czy komputery mogą myķleæ (kiedyķ)?" lub "Czy mogą myķleæ (teraz)?" Czy mamy na myķli, ŋe mogą (w zasadzie) byæ w stanie, ale nigdy nie bylibyķmy w stanie go zbudowaæ? Czy teŋ prosimy o rzeczywistą demonstrację? Niektórzy uwaŋają, ŋe maszyny myķlące mogą byæ tak skomplikowane, ŋe nigdy nie moglibyķmy ich zbudowaæ. Nilsson czyni analogię z próbą zbudowania systemu, który na przykģad powielaģby ziemską pogodę. Byæ moŋe będziemy musieli zbudowaæ system nie mniej zģoŋony niŋ faktyczna powierzchnia Ziemi, atmosfera i pģywy. Podobnie, ludzka inteligencja na peģną skalę moŋe byæ zbyt skomplikowana, aby istnieæ poza jej ucieleķnieniem u ludzi usytuowanych w otoczeniu. Na przykģad, w jaki sposób maszyna moŋe zrozumieæ, czym jest "drzewo" lub czym "jabģko" smakuje bez ucieleķnienia w prawdziwym ķwiecie? Lub moŋemy podkreķliæ drugie sģowo - "Czy komputery mogą myķleæ?", Ale co rozumiemy przez "komputery"? Definicja komputerów zmienia się z roku na rok, a definicja w przyszģoķci moŋe byæ bardzo róŋna od dzisiejszej, a najnowsze osiągnięcia w dziedzinie komputerów molekularnych, komputerów kwantowych, komputerów z moŋliwoķcią noszenia na ciele, komputerów przenoķnych i wszechobecnych komputerów zmieniają sposób myķlimy o komputerach. Byæ moŋe moŋemy zdefiniowaæ komputer jako maszynę. Znaczna częķæ literatury AI uŋywa sģowa "maszyna" zamiennie ze sģowem komputer - więc pytanie "Czy maszyny myķlą?" jest często uwaŋane za synonim "Czy komputery mogą myķleæ?" Ale czym są maszyny? I czy ludzie są maszyną? (Jeķli są, jak mówi Nilsson, wtedy maszyny mogą myķleæ!) Nilsson wskazuje, ŋe naukowcy zaczynają teraz wyjaķniaæ rozwój i funkcjonowanie organizmów biologicznych w taki sam sposób, jak maszyny (badając genomowy "plan" kaŋdego organizmu). Oczywiķcie, "biologiczne" maszyny wykonane z biaģek mogą myķleæ (my!), Ale czy "krzemowe" maszyny mogģyby kiedykolwiek myķleæ? I wreszcie moŋemy podkreķliæ trzecie sģowo - "Czy komputery mogą myķleæ?" Ale co to znaczy myķleæ? Byæ moŋe chcemy myķleæ "jak" my (ludzie). Alan Turing, brytyjski matematyk i jeden z pierwszych badaczy AI, opracowaģ sģynny (a takŋe kontrowersyjny) test empiryczny na inteligencję, która nosi jego imię - test Turinga. W tym teķcie maszyna próbuje przekonaæ ludzkiego ķledczego ŋe jest czģowiekiem . (Patrz poniŋej). Ten test zostaģ poddany intensywnej krytyce w literaturze AI, byæ moŋe niesprawiedliwie, poniewaŋ nie jest jasne, czy test jest prawdziwym testem na inteligencję. W przeciwieņstwie do wczeķniejszego celu AI podobnego rodzaju, cel polegający na tym, ŋe system AI pokonaģ mistrza ķwiata w szachach, spotkaģ się z duŋo mniejszą krytyką.

Test Turinga

Wyobražcie sobie sytuację, w której prowadzicie oddzielne rozmowy z dwoma innymi osobami, których nie moŋecie zobaczyæ w oddzielnych pokojach, byæ moŋe za pomocą teletropii (jak u Alana Turinga), lub moŋe w pokoju rozmów przez Internet (jeķli mielibyķmy zmodernizowaæ ustawienie) . Jedna z tych osób to męŋczyzna, a drugim jest kobieta - nie wiesz którym. Twoim celem jest ustalenie, kto jest kim , poprzez rozmowę z kaŋdym z nich i zadawanie im pytaņ. Częķcią gry jest to, ŋe męŋczyzna próbuje cię nakģoniæ do uwierzenia, ŋe jest kobietą, a nie odwrotnie (inspiracja dla pomysģu Turinga pochodziģa z popularnej wiktoriaņskiej gry o nazwie Imitacja). Teraz wyobraž sobie, ŋe sytuacja się zmieniģa, a zamiast męŋczyzny i kobiety, bohaterami są komputer i czģowiek. Celem komputera jest przekonanie Cię, ŋe jest czģowiekiem, a więc dzięki temu zdaæ ten test na inteligencję, teraz nazywany "testem Turinga". Jak realistyczny jest ten test? Joesph Weizenbuam zbudowaģ jeden z pierwszych chatbotów, zwany ELIZA, w 1966 roku. Jego sekretarka znalazģa program uruchomiony na jednym komputerze i zaczęģa ģuskaæ historię swojego ŋycia przez okres kilku tygodni i byģa przeraŋona, gdy Weizenbaum powiedziaģa jej, ŋe to byģo tylko program. Jednak nie byģa to sytuacja, w której zdano test Turinga. Test Turinga jest testem kontradyktoryjnym w tym sensie, ŋe jest to gra, w której jedna strona próbuje oszukaæ drugą, ale druga strona jest tego ķwiadoma i stara się nie daæ się oszukaæ. To wģaķnie sprawia, ŋe test jest trudnym testem dla systemu sztucznej inteligencji. Podobnie, istnieje wiele stron internetowych w Internecie, które twierdzą, ŋe ich chatbot zdaģ test Turinga; jednak do niedawna ŋaden chatbot nawet się do tego nie zbliŋyģ. Istnieje otwarty (i często oczerniany) konkurs, zwany Konkursem Loebnera, który odbywa się co roku, gdzie programiķci mogą przetestowaæ swoje chatboty AI, aby sprawdziæ, czy mogą zdaæ test Turinga. Konkurencja z 2008 roku byģa godna uwagi, poniewaŋ najlepsza sztuczna inteligencja byģa w stanie oszukaæ jedną czwartą sędziów w przekonaniu, ŋe jest czģowiekiem, co stanowi znaczny postęp w stosunku do wyników w poprzednich latach. Zapewnia to nadzieję, ŋe komputer będzie mógģ zdaæ test Turinga w niezbyt odlegģej przyszģoķci. Czy jednak test Turinga jest naprawdę dobrym testem na inteligencję? Byæ moŋe, gdy komputer przeszedģ ostateczne wyzwanie, jakim jest oszukiwanie panelu ekspertów AI, moŋemy oceniæ skutecznoķæ tego komputera w zadaniach innych niŋ test Turinga. Następnie, dzięki tym dalszym ocenom, będziemy w stanie okreķliæ, na ile naprawdę jest test Turinga (lub nie). W koņcu komputer pokonaģ juŋ mistrza ķwiata w szachach, ale tylko za pomocą metod wyszukiwania z funkcjami oceny, które wykorzystują minimalną "inteligencję". I co tak naprawdę nauczyliķmy się o inteligencji - poza tym, jak budowaæ lepsze algorytmy wyszukiwania? Warto zauwaŋyæ, ŋe cel, jakim jest zdobycie komputera do pokonania mistrza ķwiata, jest znacznie mniej krytykowany niŋ zdanie testu Turinga, a mimo to ten pierwszy zostaģ osiągnięty, podczas gdy drugi nie (jeszcze). Debatę wokóģ testu Turinga dobrze pokazuje praca Roberta Horna. Zaproponowaģ język wizualny jako formę wizualnego myķlenia. Częķæ jego pracy objęģa produkcję siedmiu plakatów, które podsumowują debatę Turinga w AI, aby zademonstrowaæ jego wizualny język i wizualne myķlenie. Siedem plakatów obejmuje następujące pytania:

1. Czy komputery mogą myķleæ?

2. Czy test Turinga moŋe okreķliæ, czy komputery mogą myķleæ?

3. Czy mogą myķleæ fizyczne systemy symboli?

4. Czy chiņskie pokoje mogą myķleæ?

5. (i) Czy sieci ģączące mogą myķleæ? oraz (ii) Czy komputery mogą myķleæ obrazami?

6. Czy komputery muszą byæ ķwiadome, aby myķleæ?

7. Czy myķlenie komputerów jest moŋliwe matematycznie?

Te plakaty są nazywane "mapami", poniewaŋ zapewniają mapę 2D, której pytania pokrywają się z innymi pytaniami, uŋywając analogii badaczy odkrywających niezbadane terytorium. Pierwszy plakat mapuje eksploracje pytania "Czy komputery myķlą?" I pokazuje ķcieŋki prowadzące do dalszych pytaņ wymienionych poniŋej:

• Czy komputery mają wolną wolę?

• Czy komputery mogą mieæ emocje?

• Czy powinniķmy udawaæ, ŋe komputery nigdy nie będą w stanie myķleæ?

• Czy Bóg nie pozwala komputerom myķleæ?

• Czy komputery rozumieją arytmetykę?

• Czy komputery mogą narysowaæ analogie?

• Czy komputery są z natury wyģączone?

• Czy komputery mogą byæ kreatywne?

• Czy komputery mogą się logicznie nauczyæ?

• Czy komputery mogą byæ osobami?

Drugi z nich omawia debatę na temat testu Turinga: "Czy test Turinga moŋe decydowaæ o tym, czy komputery mogą myķleæ?". Inne pytania, które zostaģy zmapowane na tym plakacie, to:

• Czy gra symulacyjna moŋe decydowaæ, czy komputery mogą myķleæ?

• Czy symulowana inteligencja przemija, czy jest inteligentna?

• Ile maszyn zdaģo test?

• Czy niepowodzenie testu jest decydujące?

• Czy zdanie testu jest decydujące?

• Czy test, rozumiany behawioralnie lub operacyjnie jest legalnym testem inteligencji?

Jedną ze szczególnych ķcieŋek do sztucznej inteligencji, którą będziemy stosowaæ, jest zasada projektowania, ŋe system sztucznej inteligencji powinien byæ zbudowany przy uŋyciu zorientowanego na agenta wzorca projektowego, a nie alternatywy, takiej jak zorientowany obiektowo wzór projektowy. Agenci uosabiają silniejsze pojęcie autonomii niŋ obiektów, sami decydują o tym, czy wykonaæ dziaģanie na ŋądanie innego agenta i są zdolni do zachowania elastycznego (reaktywnego, proaktywnego, spoģecznego), podczas gdy standardowy model obiektu nie ma nic wspólnego z powiedz o tych typach zachowaņ, a obiekty nie mają kontroli nad tym, kiedy są wykonywane. Kolejna ķcieŋka, którą będziemy ķledziæ, to poģoŋenie silnego nacisku na znaczenie AI opartej na zachowaniach oraz na wcielenie i usytuowanie agentów w zģoŋonym ķrodowisku. Wczesne przeģomowe prace w tej dziedzinie dotyczyģy Brooksa w robotyce oraz Lakoffa i Johnsona w dziedzinie językoznawstwa. Architektura podsieci Brooksa, obecnie popularna w robotyce i wykorzystywana w innych dziedzinach, takich jak animacja behawioralna i inteligentni wirtualni agenci, adoptuje moduģową metodologię dzielenia inteligencji na warstwy zachowaņ, które kontrolują wszystko, co robi agent, na podstawie faktycznego fizycznego usytuowania w jego otoczeniu i dynamicznej reakcji z nim. Lakoff i Johnson podkreķlają znaczenie metafory pojęciowej w języku naturalnym (np. Uŋycie sģów "przeģomowe" na początku tego paragrafu) i jak jest ona powiązana z naszym postrzeganiem poprzez naszą ucieleķnienie i fizyczne uziemienie. Prace te poģoŋyģy podwaliny pod obszary badawcze ucieleķnionej nauki kognitywnej i poznania usytuowanego, a spostrzeŋenia z tych obszarów zostaną równieŋ zaczerpnięte z tych podręczników.

IX Zastrzeŋeņ Alana Turinga wobec Sztucznej Inteligencji

1.3 Zastrzeŋenia wobec sztucznej inteligencji

Przez lata byģo wiele zastrzeŋeņ do Sztucznej Inteligencji. Jest to zrozumiaģe, do pewnego stopnia, poniewaŋ pojęcie inteligentnej maszyny, która moŋe potencjalnie wyprzedziæ i przeķcignąæ nas w przyszģoķci, jest przeraŋające. Byæ moŋe jest to napędzane przez wiele nierealistycznych powieķci science fiction i filmów wyprodukowanych w ciągu ostatniego stulecia, które koncentrują się na popularnym motywie robotów niszczących ludzkoķæ lub przejmujących ķwiat. Sztuczna inteligencja moŋe zakģóciæ kaŋdy aspekt naszego obecnego ŋycia, a ta niepewnoķæ moŋe równieŋ zagraŋaæ ludziom, którzy martwią się, jakie zmiany mogą przynieķæ w przyszģoķci. Następujące technologie zostaģy okreķlone jako wschodzące, potencjalnie "destrukcyjne" technologie, które oferują "nadzieję na poprawę kondycji ludzkiej", w raporcie zatytuģowanym "Future Technologies, Today's Choices", zleconym Greenpeace Environmental Trust:

• Biotechnologia;

• Nanotechnologia;

• Kognitywistyka;

• Robotyka;

• Sztuczna inteligencja.

Ostatnie trzy z nich odnoszą się bezpoķrednio do obszaru inteligencji maszyn i wszystkie moŋna scharakteryzowaæ jako potencjalnie destrukcyjne, umoŋliwiające i interdyscyplinarne. Gģównym efektem tych nowych technologii będzie róŋnorodnoķæ produktów ("oczekuje się, ŋe ich pojawienie się na rynku" wpģynie na prawie kaŋdy aspekt naszego ŋycia "w nadchodzących dziesięcioleciach"). Technologie zakģócające przenoszą starsze technologie i "umoŋliwiają przejęcie radykalnie nowych generacji istniejących produktów i procesów" oraz umoŋliwiają zupeģnie nowe klasy produktów, które wczeķniej nie byģy moŋliwe do zrealizowania. Jak napisano w raporcie: "Implikacje dla przemysģu są znaczne: firmy, które nie dostosowują się szybko, stają w obliczu przestarzaģoķci i upadku, podczas gdy te, które zajmują się i zauwaŋają, będą mogģy robiæ nowe rzeczy w niemal kaŋdej moŋliwej dyscyplinie technologicznej". Aby zilustrowaæ gģęboki wpģyw destrukcyjnej technologii na spoģeczeņstwo, naleŋy jedynie wziąæ pod uwagę przykģad komputera, a ostatnio takŋe wyszukiwarki takie jak Google i wpģyw, jaki te technologie wywarģy na wspóģczesne spoģeczeņstwo. John Searle opracowaģ wysoce dyskutowany sprzeciw wobec Sztucznej Inteligencji. Zaproponowaģ eksperyment myķlowy, zwany obecnie "pokojem chiņskim", aby przekonaæ się, w jaki sposób system sztucznej inteligencji nigdy nie miaģby umysģu podobnego do tego, który ma ludzkoķæ, lub miaģ zdolnoķæ zrozumienia naszego sposobu dziaģania

Chiņski pokój Searle′a

Wyobraž sobie, ŋe masz program komputerowy, który moŋe przetwarzaæ znaki chiņskie jako dane wejķciowe i produkowaæ chiņskie znaki jako dane wyjķciowe. Ten program, jeķli jest wystarczająco dobry, będzie miaģ zdolnoķæ do zaliczenia testu Turinga dla Chiņczyków - to znaczy, moŋe przekonaæ czģowieka, ŋe jest native speakerem chiņskim. Wedģug zwolenników testu Turinga, oznaczaģoby to, ŋe komputery mają zdolnoķæ rozumienia języka chiņskiego. Teraz wyobraž sobie jeszcze jeden moŋliwy sposób dziaģania programu. Osoba, która zna tylko angielski, zostaģa zamknięta w pokoju. Pokój jest peģen pudeģek chiņskich symboli ("baza danych") i zawiera ksiąŋkę z instrukcjami w języku angielskim ("program") o tym, jak manipulowaæ strunami chiņskich znaków. Osoba otrzymuje oryginalne chiņskie znaki za poķrednictwem jakiegoķ urządzenia do komunikacji wejķciowej. Następnie konsultuje się z ksiąŋką i postępuje zgodnie z instrukcjami, i produkuje strumieņ wyjķciowy chiņskich znaków, które następnie wysyģa przez wyjķciowe urządzenie komunikacyjne. Celem tego eksperymentu myķlowego jest twierdzenie, ŋe chociaŋ program komputerowy moŋe mieæ zdolnoķæ do konwersacji w języku naturalnym, nie ma prawdziwego zrozumienia, jakie ma miejsce. Komputery mają jedynie moŋliwoķæ uŋywania reguģ syntaktycznych do manipulowania symbolami, ale nie mają zrozumienia znaczenia (lub semantyki) z nich. Searle powiedziaģ: "Argumentacja jest następująca: jeķli czģowiek w pokoju nie rozumie chiņskiego na podstawie wdroŋenia odpowiedniego programu do zrozumienia chiņskiego, to ŋaden inny komputer cyfrowy nie jest na tej podstawie, poniewaŋ nie ma komputera , który ma wszystko, czego czģowiek nie ma. "

Byģo wiele odpowiedzi na argument Searle'a. Podobnie jak w przypadku wielu eksperymentów z myķlą o sztucznej inteligencji, takich jak ten, argument moŋna po prostu uznaæ za niestanowiący problemu. Naukowcy zajmujący się sztuczną inteligencją zwykle go ignorują, poniewaŋ argumentacja Searle'a nie powstrzymuje nas od budowania uŋytecznych systemów AI, które dziaģają inteligentnie, i czy mają umysģ, czy myķlą w ten sam sposób jak nasz mózg, są nieistotne. Stuart Russell i Peter Norvig zauwaŋają, ŋe większoķæ badaczy AI "nie dba o silną hipotezę sztucznej inteligencji - tak dģugo, jak program dziaģa, nie obchodzi go, czy nazywacie to symulacją inteligencji czy prawdziwej inteligencji." Turing sam przedstawiģ dziewięæ zastrzeŋeņ wobec sztucznej inteligencji, które stanowią dobre podsumowanie większoķci zarzutów, które pojawiģy się w kolejnych latach od opublikowania jego pracy.

1.3.1 Zarzut teologiczny

Argument ten powstaje wyģącznie z perspektywy teologicznej - tylko ludzie z nieķmiertelną duszą mogą myķleæ, a Bóg daģ nieķmiertelną duszę tylko ludziom, a nie zwierzętom czy maszynom. Turing nie pochwalaģ takich argumentów teologicznych, ale argumentowaģ przeciwko temu z teologicznego punktu widzenia. Kolejnym problemem teologicznym jest to, ŋe stworzenie Sztucznej Inteligencji uzurpuje sobie rolę Boga jako stwórcy dusz. Turing uŋyģ analogii ludzkiej prokreacji, aby wskazaæ, ŋe mamy takŋe rolę do odegrania w tworzeniu dusz.

1.3.2 Zastrzeŋenie "Gģowy w piasku"

Dla niektórych ludzi myķlenie o konsekwencjach maszyny, która moŋe myķleæ, jest zbyt przeraŋające, aby o tym myķleæ. Ten argument jest skierowany do osób, które lubią chowaæ "gģowy w piasku", a Turing pomyķlaģ, ŋe argument jest tak faģszywy, ŋe nie zadaģ sobie trudu, aby temu zapobiec.

1.3.3 Zarzut matematycznym

Turing uznaģ ten zarzut oparty na matematycznym rozumowaniu za substancję większą niŋ dwie pierwsze. Zostaģ on podniesiony przez wiele osób, od czasu wģączenia filozofa Johna Lucasa i fizyka Rogera Penrose'a. Zgodnie z twierdzeniem Gödla o niezupeģnoķci, istnieją granice oparte na logice na pytania, na które komputer moŋe odpowiedzieæ, a zatem komputer musiaģby uzyskaæ bģędne odpowiedzi. Jednak ludzie często mylą się, więc omylna maszyna moŋe oferowaæ bardziej wiarygodną iluzję inteligencji. Dodatkowo sama logika jest ograniczoną formą rozumowania, a ludzie często nie myķlą logicznie. Sprzeciwianie się sztucznej inteligencji w oparciu o ograniczenia rozwiązania opartego na logice ignoruje fakt, ŋe istnieją alternatywne rozwiązania nie oparte na logice (takie jak na przykģad przyjęte w ucieleķnionej kognitywistyce), w których argumenty matematyczne oparte na logice nie mają zastosowania.

1.3.4 Argument ze ķwiadomoķci

Ten argument mówi, ŋe komputer nie moŋe mieæ ķwiadomych doķwiadczeņ ani zrozumienia. Odmianą tego argumentu jest eksperyment myķlowy Johna Searlea w chiņskim pokoju. Geoffrey Jefferson w 1949 podsumowuje argument: "Dopóki maszyna nie napisze sonetu lub nie skomponuje koncertu z powodu odczuwanych myķli i emocji, a nie przez przypadkowy skģad symboli, moŋemy zgodziæ się, ŋe maszyna równa się mózgowi - to znaczy , nie tylko napisze, ale wiesz, ŋe to on napisaģ. Ŋaden mechanizm nie mógģby odczuwaæ (i nie tylko sztucznie sygnalizowaæ, ģatwą manipulację) przyjemnoķci z sukcesów, ŋalu, gdy zawory się topią, ocieplają pochlebstwa, staje się nieszczęķliwy przez swoje bģędy, oczarowany seksem, gniewa się lub jest przygnębiony, kiedy nie moŋe dostaæ to, czego chce. "Turing zauwaŋyģ, ŋe ten argument wydaje się zaprzeczeniem waŋnoķci testu Turinga:" jedynym sposobem, dzięki któremu moŋna byæ pewnym, ŋe maszyna myķli, jest bycie maszyną i myķlenie ". Jest to oczywiķcie niemoŋliwe do osiągnięcia, tak jak nie moŋna tego byæ pewnym , ŋe ktokolwiek inny myķli, ma emocje i jest ķwiadomy w taki sam sposób jak my sami. Niektórzy twierdzą, ŋe ķwiadomoķæ jest nie tylko domeną ludzi, ale takŋe ma ķwiadomoķæ. Zatem brak powszechnie akceptowanej definicji ķwiadomoķci stwarza problemy dla tego argumentu.

1.3.5 Argumenty z róŋnych rodzajów uģomnoķci

Te argumenty przyjmują postaæ, ŋe komputer moŋe robiæ wiele rzeczy, ale nigdy nie byģby zdolny do X. W przypadku X, Turing zaproponowaģ następującą selekcję: "bądž miģy, zaradny, piękny, przyjazny, z inicjatywą, poczuciem humoru, odróŋniaj dobro od zģa, popeģniaj bģędy, zakochaj się, ciesz się truskawkami i ķmietaną, spraw, aby ktoķ się w nim zakochaģ, ucz się z doķwiadczenia, uŋywaj sģów poprawnie, bądž przedmiotem wģasnej myķli, bądž tak róŋnorodny w zachowaniu jak czģowiek Zróbcie coķ naprawdę nowego".Turing zauwaŋyģ, ŋe zazwyczaj uzasadnione jest uzasadnienie tych argumentów, a niektóre z nich są po prostu odmianami argumentu ķwiadomoķci. Ten argument pomija takŋe wszechstronnoķæ maszyn i czystą pomysģowoķæ ludzi, którzy je budują. Większoķæ listy Turinga zostaģa juŋ osiągnięta w róŋnym stopniu, z wyjątkiem zakochania się i cieszenia truskawkami i ķmietaną. (Turing uznaģ to za "idiotyczną" rzecz, którą moŋna zrobiæ maszyna). Agenci afektywni zostali juŋ zbudowani, aby byæ ŋyczliwym i przyjaznym. Niektórzy wirtualni agenci i gry komputerowe mają inicjatywę i są niezwykle zaradni. Ageni konwersacyjni wiedzą, jak poprawnie uŋywaæ sģów; niektórzy mają poczucie humoru i potrafią odróŋniæ dobro od zģa. Bardzo ģatwo jest zaprogramowaæ maszynę, aby popeģniģa bģąd. Niektóre generowane komputerowo twarze kompozytowe i twarz Julesa , androgenicznego robota są statystycznie doskonaģe, dlatego moŋna je uznaæ za piękne. Samoķwiadomoķæ, czyli bycie przedmiotem wģasnych myķli, zostaģo juŋ osiągnięte przez robota Nico w ograniczonym sensie. Pojemnoķæ pamięci masowej i moŋliwoķci przetwarzania wspóģczesnych komputerów nakģadają niewiele ograniczeņ na liczbę zachowaņ, jakie moŋe wykazywaæ komputer. (Trzeba tylko graæ w grę komputerową ze zģoŋoną sztuczną inteligencją, aby zaobserwowaæ duŋą róŋnorodnoķæ sztucznych zachowaņ). Aby komputery zrobiģy coķ naprawdę nowego, zobacz następny zarzut.

1.3.6 Zastrzeŋenie Lady Lovelace

Ten zarzut stwierdza, ŋe komputery nie są zdolne do oryginalnego myķlenia. Lady Loveless napisaģa wspomnienie w 1842 r. (Zawarte w szczegóģowej informacji z Analitical Engine Babbage′a) stwierdzając, ŋe: "Silnik Analityczny nie ma ŋadnych pretensji aby coķ zainicjowaæ. Moŋe zrobiæ wszystko, jeķli wiemy, w jakiej kolejnoķci to wykonaæ". Turing argumentowaģ, ŋe pamięæ mózgu jest podobna do pamięci komputera i nie ma powodu, aby sądziæ, ŋe komputery nie są w stanie zaskoczyæ ludzi. Rzeczywiķcie, zastosowanie programowania genetycznego stworzyģo wiele nowych wynalazków posiadających zdolnoķæ patentową. Na przykģad NASA uŋywaģ programowania genetycznego w celu opracowania anteny, która zostaģa zastosowana na statku kosmicznym w 2006 r. . Antena ta zostaģa uznana za konkurencyjną dla ludzi, poniewaŋ zapewniaģa podobną wydajnoķæ, co antena zaprojektowana przez czģowieka, ale jej konstrukcja byģa caģkowicie nowa.

1.3.7 Argument z ciągģoķci ukģadu nerwowego

Turing przyznaģ, ŋe mózg nie jest cyfrowy. Neurony strzelają impulsami, które mają komponenty analogowe. Turing sugeruje, ŋe kaŋdy system analogowy moŋe byæ ģatwo symulowany do dowolnego stopnia dokģadnoķci. Inną formą tego argumentu jest to, ŋe mózg przetwarza sygnaģy (z bodžców), a nie symbole. Istnieją dwa paradygmaty w sztucznej inteligencji - symboliczne i subsymboliczne (lub koneksjonistyczne) - które protagoniķci uwaŋają za najlepszy sposób rozwoju inteligentnych systemów. Pierwsza z nich kģadzie nacisk na podejķcie do przetwarzania symboli z góry na dóģ (systemy oparte na wiedzy są jednym z przykģadów), podczas gdy drugi kģadzie nacisk na podejķcie oddolne z symbolami fizycznie uziemionymi w pewien sposób (na przykģad sieci neuronowe). Paradygmaty symboliczne i subimienne staģy się zaciekģą debatą w sztucznej inteligencji i naukach kognitywnych na przestrzeni lat, i podobnie jak w przypadku wszystkich debat, zwolennicy często przyjmowali wzajemnie wykluczające się punkty widzenia. Metody ģączące aspekty obu podejķæ mają pewne zalety, takie jak przestrzenie pojęciowe, co podkreķla, ŋe reprezentujemy informacje na poziomie koncepcyjnym - to znaczy, ŋe pojęcia są kluczowym elementem i zapewniają poģączenie między bodžcami i symbolami.

1.3.8 Argument z nieformalnoķci zachowania

Ludzie nie mają skoņczonego zestawu zachowaņ - improwizują w oparciu o okolicznoķci. W związku z tym, jak moglibyķmy opracowaæ zestaw zasad lub praw, które opisywaģyby, co dana osoba powinna robiæ w kaŋdej moŋliwej sytuacji? Turing przedstawiģ tę argumentację w następujący sposób: "jeķli kaŋdy czģowiek miaģby okreķlony zestaw zasad postępowania, które regulowaģby jego ŋycie, nie byģby lepszy od maszyny. Ale nie ma takich zasad, więc ludzie nie mogą byæ maszynami. "Turing twierdzi, ŋe tylko dlatego, ŋe nie wiemy, jakie są prawa, nie oznacza to, ŋe nie istnieją takie prawa. Argument ten ujawnia takŋe bģędne przekonanie, do czego zdolny jest komputer. Jeķli myķlimy o komputerach jako 'maszynach' moŋemy ģatwo popeģniæ bģąd uŋywając pojęcia, które moŋemy kojarzyæ z wieloma maszynami, których uŋywamy w codziennym ŋyciu (takimi jak wiertarka lub samochód). Ale niektóre maszyny - tj. komputery - są zdolne do znacznie więcej niŋ te prostsze maszyny. Są zdolne do zachowania autonomicznego i mogą obserwowaæ i reagowaæ na zģoŋone ķrodowisko, powodując w rezultacie poŋądaną zģoŋonoķæ zachowania. Niektóre z nich wykazują równieŋ emergentne (niezaprogramowane) zachowania ze swoich interakcji ze ķrodowiskiem, takie jak stukanie stóp przez wirtualne pająki, które odzwierciedla zachowanie pająków w prawdziwym ŋyciu.

1.3.9 Argument z percepcji pozazmysģowej

Ten ostatni zarzut ma dziķ mniejsze znaczenie, poniewaŋ odzwierciedla zainteresowanie dodatkową percepcją sensoryczną (ESP), które byģo szeroko rozpowszechnione w czasie, gdy Turing opublikowaģ swój artykuģ. Argument jest taki, ŋe jeķli ESP jest moŋliwe u ludzi, to moŋna to wykorzystaæ do uniewaŋnienia testu Turinga. (Komputer moŋe byæ w stanie dokonaæ losowych przewidywaņ w grze zgadującej karty, podczas gdy czģowiek z umiejętnoķciami czytania umysģu moŋe byæ w stanie odgadnąæ lepiej niŋ przypadek.) Turing omówiģ sposoby, w których warunki testu mogą zostaæ zmienione w celu przezwycięŋenia to. Kolejny zarzut dotyczy postrzegania braku konkretnych wyników, które badania AI wytworzyģy w ponad póģ wieku staraņ. Wspomniany wczeķniej raport wyjaķniaģ ciągģą poraŋkę badaņ nad sztuczną inteligencją: "Uwaŋa się, ŋe obecne systemy AI są zasadniczo niezdolne do ujawnienia inteligencji, tak jak ją rozumiemy." Termin "AI Winter" odnosi się do poglądu, ŋe badania i rozwój Sztucznej Inteligencji sģabnie i trwa to juŋ od jakiegoķ czasu. Powiązane z tym jest przekonanie, ŋe Sztuczna Inteligencja nie jest juŋ godnym miejscem badawczym, poniewaŋ (w niektórych umysģach) nie speģniģa się spektakularnie w speģnianiu swoich obietnic, odkąd termin zostaģ sformuģowany na konferencji Dartmouth w 1956 roku (tej konferencji teraz przypisuje się wprowadzenie terminu "Sztuczna inteligencja"). Wbrew mitowi, ŋe istnieje AI Winter, tempo badaņ gwaģtownie roķnie. Jednym z gģównych czynników przyszģych badaņ będzie branŋa rozrywkowa - potrzeba realistycznej interakcji z postaciami niezaleŋnymi (NPC) w branŋy gier oraz dąŋenie do większej wiarygodnoķci w powiązanych sektorach filmowych i telewizyjnych. Branŋe te mają znaczne wpģywy finansowe i mają prawie nieograniczony potencjaģ do zastosowania technologii sztucznej inteligencji. Na przykģad przeksztaģcenie rzeczywistoķci telewizyjnej w gry komputerowe online moŋe doprowadziæ do w peģni interaktywnej telewizji w niezbyt odlegģej przyszģoķci gdzie widzowie będą zanurzani i będą mogli wpģywaæ na historię, którą oglądają (poprzez gģosowanie na moŋliwe wyniki - np. czy zabiæ jednego z gģównych aktorów). Alternatywną moŋliwoķcią moŋe byæ poģączenie animacji komputerowej, symulacji i technologii sztucznej inteligencji ,prowadziæ do filmów, które moŋna oglądaæ wiele razy, za kaŋdym razem z róŋnymi wynikami, w zaleŋnoķci od tego, co wydarzyģo się podczas symulacji. Pomimo tych interesujących wydarzeņ w branŋy rozrywkowej, gdzie AI nie jest postrzegana jako zagroŋenie, coraz większe zaangaŋowanie technologii sztucznej inteligencji w inne aspekty naszego codziennego ŋycia budzi coraz większy niepokój wielu osób. Kevin Warwick w swojej ksiąŋce "The March of the Machines" z 1997 roku przewidziaģ, ŋe roboty lub super-inteligentne maszyny przemocą przejęģyby ludzkoķæ za następne 50 lat. Jednym z powodów takiego myķlenia jest projekcja, ŋe komputery wyprzedzą moc przetwarzania ludzkiego mózgu juŋ w 2020 r. Na przykģad w tej projekcji przewidziano, ŋe komputery mają juŋ zdolnoķæ przetwarzania pająków - a niedawne symulacje stawonogów Sztucznego Ŋycia pokazaģy, jak moŋna obecnie uzyskaæ wiarygodną animację dynamiczną pająków w czasie rzeczywistym. Te same ramy uŋywane do symulacji zostaģy rozszerzone na jaszczurki. Zarówno jaszczurka jak i odpowiednik pająka, zostaģ przewidziany przez Moraveca aby juŋ zostaģ osiągnięty. Jednak w przeciwieņstwie do wykresu Moraveca róŋnica między wirtualnymi pająkami a wirtualnymi jaszczurkami byģa znacznie mniejsza. Jeķli takie ramy mogą byæ dostosowane do naķladowania ssaków i ludzi, wówczas wiarygodne ludzkie symulacje mogą byæ bliŋsze niŋ początkowo sądzono. Nieporozumienia dotyczące maszyn przejmujących rasę ludzką, które grają na niepoinformowanych niepokojach i obawach ludzi, mogą niestety mieæ wpģyw na politykę publiczną wobec badaņ i rozwoju. Na przykģad, petycja z Instytutu Wynalazków Spoģecznych stwierdza: "W związku z prawdopodobieņstwem, ŋe na początku następnego tysiąclecia komputery i roboty będą rozwijane ze zdolnoķcią i zģoŋonoķcią większą niŋ ludzki mózg, a takŋe z potencjaģem aby dziaģaæ zģowrogo w stosunku do ludzi, my, niŋej podpisani, wzywamy polityków i stowarzyszenia naukowe do powoģania międzynarodowej komisji monitorującej i kontrolującej rozwój systemów sztucznej inteligencji. ".

Chris Malcolm dostarcza przekonujących argumentów w serii artykuģów, dlaczego roboty nie rządzą ķwiatem. Podkreķla, ŋe tempo wzrostu inteligencji jest znacznie wolniejsze niŋ tempo wzrostu mocy obliczeniowej. Na przykģad Moravec przewiduje, ŋe będziemy mieli w peģni inteligentne roboty w 2050, chociaŋ do 2020 roku będziemy mieæ komputery o większej mocy obliczeniowej niŋ mózg. Malcolm podkreķla takŋe niebezpieczeņstwa związane z "antropomorfizmem i interpretowaniem wszystkiego". Na przykģad, trudno uniknąæ nie przypisywania emocji i uczuæ, obserwując zadziwiająco ŋywy, sztuczny klon Hiroshi Ishiguro, zwany Geminoidem, lub androgenicznego androida Hansona Roboticsa. Joseph Weizenbaum, który opracowaģ Elizę, chatbota z umiejętnoķcią symulowania Rogeriana i jedną z pierwszych prób przejķcia testu Turinga, byģ tak zaniepokojony niedoinformowanymi odpowiedziami osób, które nalegaģy, by traktowaæ Elizę jako prawdziwą osobę, ŋe "rasa ludzka po prostu nie byģa intelektualnie dojrzaģa, by mieszaæ się z tak kuszącą nauką, jak sztuczna inteligencja"

Eksperymenty konceptualnej metafory, analogii i myķlowe

Duŋa częķæ języka skģada się z metafory pojęciowej i analogii. Na przykģad analogia między badaniami sztucznej inteligencji a fizyczną eksploracją wykorzystuje przykģady metafory pojęciowej, która ģączy pojęcia "badania nad sztuczną inteligencją" i "eksploracja". Lakoff i Johnson podkreķlają waŋną rolę, jaką metafora pojęciowa odgrywa w języku naturalnym i jak są one powiązane z naszymi fizycznymi doķwiadczeniami. Twierdzą, ŋe metafora jest wszechobecna nie tylko w języku potocznym, ale w naszych myķlach i dziaģaniu, będąc podstawową cechą ludzkiego systemu pojęciowego. Rozpoznanie uŋycia metafory i analogii w języku moŋe pomóc w zrozumieniu i uģatwieniu uczenia się. Na przykģad opracowano koncepcyjne ramy metaforyczne dla biologii i nauczania matematyki. Analogia i metafora pojęciowa są waŋnymi językowymi narzędziami do wyjaķniania związków między pojęciami. Metaforę rozumie się przez znalezienie analogii odwzorowania między dwiema domenami - między bardziej abstrakcyjną docelową domeną koncepcyjną, którą próbujemy zrozumieæ, a žródģową koncepcyjną domeną, która jest žródģem wyraŋeņ metaforycznych. Lakoff i Johnson dokģadnie zbadali powszechnie uŋywane pojęciowe metafory, takie jak "ŊYCIE TO PODRÓŊ", i "CZAS TO PIENIĄDZE", które pojawiają się w codziennych zwrotach, których uŋywamy w języku. Oto kilka przykģadów: "Mam przed sobą swoje ŋycie", "Zaatakowaģ mój argument" i "Zainwestowaģem w to duŋo czasu". Zrozumienie tych zdaņ wymaga od czytelnika lub sģuchacza zastosowania cech z bardziej zrozumiaģych pojęæ, takich jak PODRÓŊ, WOJNA i PIENIĄDZE, do mniej zrozumiaģych, bardziej abstrakcyjnych pojęæ, takich jak ŊYCIE, i CZAS. W wielu przypadkach bardziej zrozumiaģa lub bardziej "konkretna" koncepcja pochodzi z dziedziny odnoszącej się do naszego fizycznie wcielonego ludzkiego doķwiadczenia (np. Metafora "UP IS GOOD" uŋyta w wyraŋeniu "Things is lookup up"). Innym przykģadem jest metafora kartograficzna, która jest podstawą "map" Roberta Horna. Analogia, podobnie jak metafora, rysuje podobieņstwo między rzeczami, które początkowo mogą wyglądaæ inaczej. Pod pewnymi względami moŋemy uznaæ analogię za formę argumentu, którego celem jest przybliŋenie relacji między parami porównywanych pojęæ, podkreķlenie dalszych podobieņstw i pomoc przez porównanie nieznanego podmiotu z bardziej znanym. Analogia wydaje się byæ podobna do metafory w roli, w której gra, więc jak się róŋnią? Wedģug internetowego sģownika Merriam-Webster metafora jest "figurą wypowiedzi, w której sģowo lub fraza dosģownie oznaczają jeden rodzaj przedmiotu lub idei jest uŋywany zamiast innego, aby zasugerowaæ podobieņstwo lub analogię między nimi (jak przy topieniu pieniędzy). "Analogię definiuje się jako" wnioskowanie, ŋe jeķli dwie lub więcej rzeczy zgadzają się ze sobą pod pewnymi względami, prawdopodobnie zgodzą się w innych " a takŋe "podobieņstwo w niektórych szczegóģach między rzeczami innymi w odróŋnieniu. Zasadnicza róŋnica polega na tym, ŋe metafora jest postacią mowy, w której jedna rzecz ma na myķli inną, podczas gdy analogia nie jest jedynie figurą - moŋe byæ logicznym argumentem, ŋe jeķli dwie rzeczy są podobne pod pewnymi względami, będą one podobne na inne sposoby. Język uŋywany do opisywania informatyki i sztucznej inteligencji jest często bogaty w uŋycie metafory pojęciowej i analogii. Jednak rzadko są one wyražnie okreķlone, a zamiast tego czytelnik często jest pozostawiony do wywnioskowania z uŋytych sģów, powstaje niejawny związek. My uŋyjemy analogii (i metafory pojęciowej), aby wyražnie podkreķliæ, jak dwa pojęcia są ze sobą powiązane, jak pokazano poniŋej:

• Wirus komputerowy w informatyce jest analogiczny do "wirusa" w prawdziwym ŋyciu.

• "Robak komputerowy" w informatyce jest analogiczny do "robaka" w prawdziwym ŋyciu.

• "Pająk internetowy" w informatyce jest analogiczny do "pająka" w prawdziwym ŋyciu.

• "Internet" w informatyce jest analogiczny do "sieci pajęczej w prawdziwym ŋyciu.

• "Strona internetowa" w informatyce jest analogiczna do "ķrodowiska" w prawdziwym ŋyciu.

W tych przykģadach wyražnie stwierdzono między wirusami komputerowymi pojęcia "wirus komputerowy", "robak komputerowy", "pająk internetowy" i "Internet" oraz ich rzeczywiste odpowiedniki. Wiele funkcji (ale nie wszystkie) związanych z nimi koncepcji (takich jak wirus w prawdziwym ŋyciu) są często uŋywane do opisania cech abstrakcyjnego pojęcia (wirus komputerowy), który jest wyjaķniony. Te analogie naleŋy pamiętaæ w porządku zrozumieæ język uŋywany do opisu pojęæ. Na przykģad, gdy uŋywamy wyraŋenia "przeszukiwanie sieci", moŋemy zrozumieæ jego ukryte znaczenie w kontekķcie trzeciej i czwartej analogii powyŋej. Alternatywne analogie (np. piąta analogia) kryją się za znaczeniem róŋnych metafor wykorzystywanych w wyraŋeniach takich jak "gubienie się podczas wyszukiwania w Internecie" i "surfowanie po Internecie". Kiedy ktoķ mówi, ŋe zgubiģ się podczas eksplorowania sieci, nie jest fizycznie zagubiony. Poza tym byģoby dziwnie mówiæ o prawdziwym pająku "surfującym" po sieci, ale moŋemy mówiæ o osobie surfującej po Internecie, poniewaŋ robimy analogię, ŋe sieæ jest jak fala w prawdziwym ŋyciu. Przykģadowe metafory związane z tą analogią to wyraŋenia takie jak "powódž informacji" i "zalewanie przez przeciąŋenie informacji". Analogia to próba utrzymania równowagi na fali informacji nad którą nie masz kontroli. Dwie waŋne analogie stosowane w sztucznej inteligencji dotyczące algorytmów genetycznych i sieci neuronowych mają podstawę biologiczną:

• "Algorytm genetyczny" w Sztucznej Inteligencji jest analogiczny do ewolucji genetycznej w biologii.

• "Sieæ neuronowa" w Sztucznej Inteligencji jest analogiczna do neuronowego przetwarzania w mózgu.

Są to przykģady "naturalnych obliczeņ" - komputerów inspirowanych naturą. W niektórych przypadkach w języku uŋywane są konkurencyjne analogie iw tym przypadku musimy wyjaķniæ kaŋdą analogię dalej, okreķlając punkty podobieņstwa i odmiennoķci (gdzie kaŋda analogia jest silna lub zaģamuje się odpowiednio) i dostarczając przykģady metafor uŋyte w tekķcie, który wyciąga analogię. Na przykģad moŋna dokonaæ analogii między docelową koncepcją "badania" i konkurującymi pojęciami žródģowymi "eksploracja" i "budowa" w następujący sposób:

Analogia 1 "Badania" w nauce są analogiczne do "eksploracji" w prawdziwym ŋyciu.

Punkty podobieņstwa: samo sģowo "badanie" równieŋ stosuje analogię eksploracji: moŋemy myķleæ o tym jako o procesie z powrotem (powtórzenie) wyszukiwania, które juŋ zrobiliķmy. Punkty niepodobieņstwa: wymyķlanie nowych pomysģów jest bardziej skomplikowane niŋ poszukiwanie nowej ķcieŋki. Musisz budowaæ na istniejących pomysģach, tworzyæ lub konstruowaæ coķ nowego z istniejących częķci. Przykģady metafor uŋytych w tym rozdziale: "Pģywamy po tym nowym morzu, poniewaŋ jest nowa wiedza, którą moŋna zdobyæ", "Ķcieŋki do sztucznej inteligencji", "Większoķæ terenów do zbadania jest wciąŋ nieznana".

Analogia 2 "Badania" w nauce są analogiczne do "konstrukcji" w prawdziwym ŋyciu.

Punkty podobieņstwa: Często mówimy, ŋe nowe pomysģy są tworzone lub budowane na podstawie istniejących pomysģów; mówimy takŋe o strukturach, które zapewniają wsparcie lub strukturę dla konkretnego pomysģu. Punkty niepodobieņstwa: wymyķlanie nowych pomysģów jest bardziej skomplikowane niŋ tylko konstruowanie lub budowanie czegoķ nowego. Czasami musisz iķæ tam, gdzie nigdy wczeķniej nie byģeķ; czasem gubisz się po drodze (coķ, co wydaje się dziwne, jeķli budujesz budynek). Przykģady metafor uŋytych w tym rozdziale: "jak budowaæ lepsze algorytmy wyszukiwania", "Zróbmy analogię", "bazuj na istniejących pomysģach", "zazwyczaj uzasadnione jest uzasadnienie tych argumentów".

Eksperymenty myķlowe

Zapewniają alternatywną metodę opisywania nowego pomysģu lub opracowywania problemów z istniejącym pomysģem. Analogią do terminu "eksperyment myķlowy" jest to, ŋe przeprowadzamy pewien eksperyment (jak naukowiec w laboratorium), ale eksperyment ten przeprowadzany jest tylko w naszym umyķle. Podobnie jak w przypadku wszystkich eksperymentów, wypróbowujemy róŋne rzeczy, aby zobaczyæ, co moŋe się wydarzyæ, jedyną róŋnicą jest to, ŋe rzeczy, które wypróbowywaliķmy, są w większoķci wykonywane tylko w naszych wģasnych myķlach. Nie ma rzeczywistych eksperymentów - to tylko proces rozumowania, który jest uŋywany przez osobę proponującą eksperymenty. W eksperymencie myķlowym zasadniczo stawiamy pytania "co jeķli" w naszych wģasnych umysģach. Na przykģad "Co jeķli X?" Lub "Co stanie się, jeķli X?", Gdzie X moŋe byæ "moŋemy daæ się zwieķæ przekonaniu, ŋe komputer to czģowiek" w eksperymencie myķlowym Turinga. Ponadto osoba, która proponuje tę myķl eksperyment polega na tym, aby inni ludzie przeprowadzili ten sam proces myķlowy we wģasnym umyķle, wyobraŋając sobie konkretną sytuację i prawdopodobne konsekwencje. Często eksperyment myķlowy wymaga postawienia się w sytuacji (w twoim umyķle), a następnie wyobraŋenia sobie, co by się staģo. Cel tego eksperymentu myķlowego polega na przedstawianiu argumentów za lub przeciw okreķlonemu punktowi widzenia, podkreķlając waŋne kwestie. Niemiecki termin eksperymentu myķlowego to Gedankeneximentiment - na przykģad istnieje wiele przykģadów stosowanych w fizyce. Jednym z najsģawniejszych postawionych przez Alberta Einsteina byģo ķciganie wiązki ķwiatģa i doprowadzenie do rozwoju Teorii Szczególnej Względnoķci. Sztuczna inteligencja ma równieŋ wiele przykģadów eksperymentów myķlowych, a kilka z nich opisano w tych podręcznikach, aby zilustrowaæ waŋne idee i koncepcje.

Zasady projektowania autonomicznych agentów

Pfeifer and Scheier proponują kilka zasad projektowania dla autonomicznych agentów:

Projekt 1.1 Zasady projektowania Pfeifer i Scheier dla autonomicznych agentów.

Design Meta-Principle: "Zasada trzech skģadników". Ta pierwsza zasada jest klasyfikowana jako meta-zasada, poniewaŋ definiuje kontekst rządzący innymi zasadami. Stwierdza on, ŋe projektowanie autonomicznych czynników obejmuje trzy skģadniki: (1) niszę ekologiczną; (2) poŋądane zachowania i zadania; i (3) sam agent. "Ķrodowisko zadaņ" obejmuje razem (1) i (2).

Zasada projektowania 1: Zasada "peģnych agentów". Agenci muszą byæ kompletni: autonomiczni; samowystarczalny; wcieleni; i poģoŋeni.

Zasada projektowania 2 : "zasada równolegģych, lužno powiązanych procesów". Inteligencja wyģania się z interakcji między agentem a ķrodowiskiem poprzez równolegģe, lužno powiązane procesy powiązane z mechanizmami zmysģowo-motorycznymi.

Zasada projektowania 3 : "zasada koordynacji sensoryczno-motorycznej". Wszystkie inteligentne zachowania (np. Percepcja, kategoryzacja, pamięæ) są wynikiem koordynacji czuciowo-ruchowej, która strukturyzuje dane zmysģowe.

Zasada projektowania 4 : "Zasada tanich projektów". Projekty są oszczędne i wykorzystują fizykę nisz ekologicznych.

Zasada projektowania 5 : "Zasada redundancji". Nadmiar jest uwzględniany w projekcie agenta z nakģadaniem się informacji między róŋnymi kanaģami sensorycznymi.

Zasada projektowania 6 : "Zasada równowagi ekologicznej". Zģoŋonoķæ agenta odpowiada zģoŋonoķci ķrodowiska zadaņ. Musi byæ dopasowanie zģoŋonoķci czujników, ukģadu ruchowego i podģoŋa neuronowego.

Zasada projektowania 7 : "Zasada wartoķci". Agent ma system wartoķci, który opiera się na mechanizmach samo-nadzorowanego uczenia się i samoorganizacji.

Te dobrze opracowane zasady mają znaczący wpģyw na projektowanie autonomicznych czynników. W przewaŋającej częķci postaramy się przestrzegaæ tych zasad podczas projektowania naszych wģasnych agentów. Będziemy takŋe wielokrotnie przeglądaæ aspekty tych zasad, gdzie będziemy bardziej szczegóģowo analizowaæ konkretne pojęcia, takie jak pojawienie się i samoorganizacja. Jednakŋe nieco zmienimy niektóre aspekty tych zasad, aby lepiej dopasowaæ terminologię i podejķcie. Zamiast odróŋniaæ trzy skģadniki, jak w metodzie projektowania i odnosiæ się do "niszy ekologicznej", wolimy uŋywaæ tylko dwóch: agentów i ķrodowisk. Ķrodowiska są waŋne dla agentów, poniewaŋ interakcja agent-ķrodowisko jest niezbędna do zģoŋonego zachowania agenta. W następnej częķci omówimy, co rozumiemy przez ķrodowisko, i spojrzymy na niektóre ķrodowiska odzwierciedlające zģoŋonoķæ realnego ķwiata. Przedstawiając rozwiązania problemów, będziemy trzymaæ się gģównie zasad projektowania opisanych powyŋej, ale z następującymi dalszymi zasadami projektowania.

Dalsze zasady projektowania dla agentów i ķrodowisk w NetLogo

Zasada projektowania 8 : Projekt powinien byæ prosty i zwięzģy (zasada "Keep It Simple Stupid" lub KISS).

Zasada projektowania 9 : Projekt powinien byæ wydajny obliczeniowo.

Zasada projektowania 10 : Projekt powinien byæ w stanie modelowaæ tak szeroką gamę zģoŋonych zachowaņ agenta i zģoŋonych ķrodowisk, jak to moŋliwe.

Gģównym powodem, dla którego projekt jest prosty i zwięzģy, jest ze względów pedagogicznych. Jednakŋe, jak zobaczymy w ostatnich rozdziaģach, prostota projektu niekoniecznie wyklucza zģoŋonoķæ zachowania agenta lub zģoŋonoķæ w ķrodowisku. Na przykģad język programowania NetLogo ma bogaty zestaw modeli, mimo ŋe większoķæ z nich ogranicza się do prostego ķrodowiska 2D uŋywanego do symulacji i wizualizacji.

Podsumowanie

Cytat z początku tej częķci odnosi się do czasu, kiedy ludzkoķæ jeszcze nie pokonaģa "ostatecznej granicy" przestrzeni. Póģ wieku póžniejszej eksploracji przestrzeni kosmicznej, byæ moŋe moŋemy uznaæ, ŋe przestrzeņ nie jest juŋ "ostateczną" granicą. Mamy wiele więcej moŋliwoķci do zbadania, chociaŋ nie jest to kwestia fizyczna tak jak przestrzeņ. Są to granice nauki i inŋynierii oraz granice umysģu. Moŋemy albo zdecydowaæ się na konfrontację z tymi trudnymi granicami, albo zignorowaæ je, utrzymując nasze "gģowy w piasku". Ta częķæ stanowi wprowadzenie do dziedziny Sztucznej Inteligencji (AI) i pozycjonuje AI jako wschodzącą, ale potencjalnie destrukcyjną technologię na przyszģoķæ. Jest to analogia między badaniem SI a eksploracją niezbadanego terytorium, oraz opisuje kilka ķcieŋek, które zostaģy podjęte w przeszģoķci w celu zbadania tego terytorium, niektóre z nich są ze sobą w konflikcie. Pojawiģo się wiele zastrzeŋeņ do sztucznej inteligencji, z których wiele zostaģo zrobionych z ludzi, którzy są žle poinformowani. W niniejszym rozdziale podkreķlono równieŋ zastosowanie metafory pojęciowej i analogii w języku naturalnym i sztucznej inteligencji. Podsumowanie waŋnych pojęæ, które moŋna wyciągnąæ z tej częķci, pokazano poniŋej:

• Istnieje wiele dróg do Sztucznej Inteligencji. Istnieje równieŋ wiele zastrzeŋeņ.

• Test Turinga jest kontrowersyjnym testem sztucznej inteligencji.

• Argument Chiņskiego Pokoju Searles'a mówi, ŋe komputer nigdy nie będzie w stanie myķleæ i rozumieæ tak, jak my. Badacze sztucznej inteligencji zwykle ignorują to i dalej budują uŋyteczne systemy sztucznej inteligencji.

• Komputery najprawdopodobniej będą miaģy moŋliwoķci przetwarzania danych do 2020 roku, ale na komputery z inteligencją prawdopodobnie poczekamy dģuŋej.

• AI Winter - nie w tej chwili.

• Konceptualna metafora i analogia - to waŋne urządzenia językowe, których powinniķmy byæ ķwiadomi, aby to zrozumieæ język naturalny.

• Pfeifer i Scheier zaproponowali kilka waŋnych zasad projektowania dla autonomicznych agentów.

Agenci i Ķrodowisko

2.1 Co to jest agent?

Systemy zorientowane na agenta staģy się jednym z najbardziej ŋywych i waŋnych obszarów informatyki. Historycznie, jednym z gģównych obszarów zainteresowania w sztucznej inteligencji byģo budowanie inteligentnych systemów. Standardowy podręcznik w AI napisany przez Russella i Norviga przyjmuje koncepcję racjonalnych agentów jako centralnych dla ich podejķcia do sztucznej inteligencji. Nacisk kģadziony jest na rozwój systemów agentów, które moŋna rozsądnie nazwaæ inteligentnymi. Systemy zorientowane na klienta są równieŋ waŋnym obszarem badaņ, który leŋy u podstaw wielu innych obszarów badawczych w dziedzinie technologii informatycznych. Na przykģad, twórcy programu Agentlink III, który jest siecią doskonaģoķci dla systemów opartych na agentach, twierdzą, ŋe agenci stanowią podstawę wielu aspektów szerszego europejskiego programu badawczego oraz ŋe "agenci stanowią najwaŋniejszy nowy paradygmat rozwoju oprogramowania od momentu orientacji". Istnieje jednak wiele nieporozumieņ dotyczących tego, co ludzie rozumieją przez "agenta". Poniŋej przedstawiono kilka perspektyw dla znaczenie terminu "agent".

Perspektywa : Sztuczna Inteligencja

Kluczowa Idea : Agent jest ucieleķniony (tj. Usytuowany) w otoczeniu i podejmuje wģasne decyzje. Odbiera on otoczenie poprzez czujniki i dziaģa na otoczenie poprzez siģownik

Obszary Zastosowania : Inteligentni agenci. Inteligentne systemy. Robotyka.

Perspektywa : Przetwarzanie Rozproszone

Kluczowa Idea : Agent to autonomiczny proces programowy lub wątek.

Obszary Zastosowania : Model trójwymiarowy (przy uŋyciu agentów). Sieci peer-to-peer. Przetwarzanie równolegģe i gridowe.

Perspektywa : Obliczenia Internetowe

Kluczowa Idea : Agent wykonuje zadanie w imieniu uŋytkownika. tj. agent dziaģa jako proxy; uŋytkownik nie moŋe wykonaæ (lub nie chce wykonaæ) zadania samodzielnie.

Obszary Zastosowania : Pająki i roboty sieciowe. Skrobaczki internetowe. Gromadzenie, filtrowanie i pobieranie informacji.

Perspektywa : Symulacja i modelowanie

Kluczowa Idea : Agent udostępnia model do symulacji dziaģaņ i interakcji autonomicznych osób w sieci.

Obszary Zastosowania : Teoria gry. Zģoŋone systemy. Systemy wieloagentowe. Programowanie ewolucyjne

Termin "bot" - skrót od robota - staģ się powszechny jako zamiennik terminu "agent". W publikacjach akademickich zwykle preferowany jest ten drugi - na przykģad agent konwersacyjny, a nie chatbot lub chatterbot - choæ są one synonimami. Lista botów jest pokazana poniŋej w nazwie zgodnie z zadaniami, które wykonują.

Nazwa(-y) botów : Opis

Chatterbots : Sģuŋą do czatowania w sieci.

Annoybots : Uŋywane do niszczenia pokojów rozmów i grup dyskusyjnych.

Spamboty : Którzy generują niepoŋądane wiadomoķci e-mail "spam") po zebraniu internetowych adresów e-mail.

Mailbots : Zarządzający i filtrującymi wiadomoķci e-mail (np. W celu sunięcia spamu).

Spiderbots : Przeszukują sieæ w celu pobrania zawartoķci do bazy danych (np. Googlebot). Do wyszukiwania silników (np. Google) jest to następnie indeksowane w pewien sposób.

Infobots : Zbierają informacje. na przykģad "Newsbots" bierają wiadomoķci; "Hotboty" znajdują najgorętsze lub najnowsze strona dla informacji; "Jobbots" zbierają informacje o pracy.

Knowbots lub Knowledgebots : Szukają konkretnej wiedzy. na przykģad "Shopbot"

Inne nazwy agentów i botów to: agenci programowi, kreatory, pająki, inteligentne roboty programistyczne, softboty i róŋne dalsze kombinacje sģów "oprogramowanie", "inteligentny", "bot" i "agent". Zamieszanie moŋe równieŋ powstaæ, poniewaŋ ludzie często przyjmują terminy z innych obszarów i przenoszą znaczenie w swoje wģasne obszary zainteresowaņ. W trakcie procesu pierwotne znaczenie tego terminu często moŋe ulec zmianie lub pomieszaniu. Na przykģad "robot" to inne okreķlenie, takie jak "agent", w którym dokģadne znaczenie jest trudne do ustalenia. Termin "robot" jest teraz mylony z terminem "bot" - wiele osób uwaŋa teraz "robot" za niekoniecznie maszynę fizyczną, poniewaŋ w ich definicji są takie rzeczy jak pająki internetowe (uŋywane w wyszukiwarkach), i konwersacyjne roboty (takie, jakie moŋna napotkaæ w tych dniach podczas dzwonienia na infolinię). Jeszcze więcej nieporozumieņ powstaje, poniewaŋ dla niektórych osób oba te mogą byæ równieŋ uwaŋane za agentów. Co moŋe takŋe powodowaæ zamieszanie z uŋyciem terminu agent, jest często związane z pojęciem "agencji", które samo w sobie moŋe mieæ wiele znaczeņ. Jednym z aspektów pojęcia agencji jest zdolnoķæ agenta do dziaģania w ķwiecie - dla ludzi wiąŋe się to z ich zdolnoķcią do dokonywania wģasnych wyborów, które będą miaģy wpģyw na ķwiat, w którym ŋyją. Znaczenie to jest ķciķle związane z znaczenie agenta, który przyjmujemy w tych ksiąŋkach. Jednak innym znaczeniem agencji jest upowaŋnienie do dziaģania w imieniu innej osoby - na przykģad biuro podróŋy jest upowaŋnione do dziaģania w imieniu swoich klientów w celu znalezienia najbardziej konkurencyjnej firmy z opcjami podróŋy. Sģownik online Merriam-Webster podaje następujące znaczenia terminu agent:

1. Który dziaģa lub wywiera moc;

a: coķ, co wytwarza lub moŋe wywoģaæ efekt: czynną lub wydajną

b: zasada chemiczna, fizyczna lub biologicznie czynna;

3. ķrodek lub narzędzie, za pomocą którego prowadząca inteligencja osiąga wynik;

4. ten, kto jest upowaŋniony do dziaģania w imieniu lub w miejsce innego: jak

a: przedstawiciel, emisariusz lub urzędnik rządu < agent korony > < agent federalny >

b: jeden zaangaŋowany w tajne dziaģania (jako szpiegostwo): szpieg

c: przedstawiciel handlowy (jako sportowiec lub artysta) < a theatrical agent >;

5. aplikacja komputerowa przeznaczona do automatyzacji niektórych zadaņ (takich jak zbieranie informacji online).

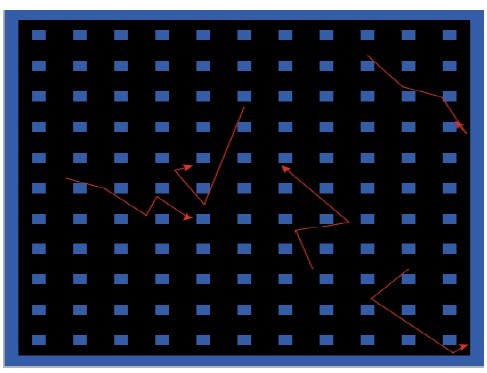

Czwarte znaczenie agenta odnosi się do znaczenia agenta często uŋywanej w ogólnym języku angielskim, takiej jak uŋywane w popularnych zwrotach "agent ubezpieczeniowy", "agent modelujący", "agent reklamowy", "tajny agent" i "agent sportowy". To moŋe wywoģaæ najwięcej zamieszania, poniewaŋ róŋni się od znaczenia agenta przyjętego i nas (co jest bardziej związane z piątym znaczeniem). Wszystkie te podobne, ale nieco inne znaczenia wywodzą się z podstawowej koncepcji "agenta". Najlepiej moŋna to zrozumieæ, zauwaŋając, ŋe agent lub system zorientowany na agenta jest analogiczny do czģowieka w prawdziwym ŋyciu. Biorąc pod uwagę tę analogię, moŋemy dokonaæ porównania między zorientowanymi na agentów systemami, które projektujemy, a atrybutami ludzi w prawdziwym ŋyciu. Ludzie podejmują wģasne decyzje, istnieją w nich, wchodzą w interakcję z otaczającym je ķrodowiskiem i wpģywają na nie. Podobnie, celem projektantów agentów jest wyposaŋenie ich systemów zorientowanych na agenta podobnymi zdolnoķciami decyzyjnymi i podobną zdolnoķcią do interakcji i wpģywania na ķrodowisko. W tym ķwietle róŋne znaczenia wymienione w definicji sģownika są powiązane ze sobą za pomocą podstawowej analogii podmiotu, który ma zdolnoķæ dziaģania dla siebie, lub w imieniu innego, lub z moŋliwoķcią wywoģania efektu, z niektórymi moŋliwoķci czģowieka. Agent istnieje (znajduje się) w ķrodowisku i jest w stanie wyczuwaæ, poruszaæ się i wpģywaæ na to ķrodowisko, podejmując wģasne decyzje, które mają wpģyw na przyszģe zdarzenia. Agent jest analogiczny do osoby w prawdziwym ŋyciu, posiadającej pewne zdolnoķci danej osoby. Z punktu widzenia sztucznej inteligencji kluczową ideą jest to, ŋe agent jest ucieleķniony (tj. Usytuowany) w ķrodowisku. Franklin i Graesser definiują autonomicznego agenta jako "system usytuowany wewnątrz i częķæ ķrodowiska, które wyczuwa to ķrodowisko i dziaģa na nie, z biegiem czasu, w dąŋeniu do wģasnej agendy i aby osiągnąæ to, co wyczuwa w przyszģoķæ". Na przykģad agent oparty na grach znajduje się w ķrodowisku wirtualnej gry, podczas gdy roboty są zlokalizowane w rzeczywistym (lub prawdopodobnie symulowanym) ķrodowisku. Agent postrzega ķrodowisko za pomocą czujników (rzeczywistych lub wirtualnych) i dziaģa na nie za pomocą siģowników (ponownie, rzeczywistych lub wirtualnych). Znaczenie terminu "agent" moŋe jednak zmieniæ nacisk, gdy stosowana jest alternatywna perspektywa, co moŋe prowadziæ do zamieszania. Ludzie często będą równieŋ uŋywaæ definicji, którą znają z wģasnego tģa i zģa. Na przykģad, przetwarzanie rozproszone, przetwarzanie w Internecie i symulacja oraz modelowanie zapewniają trzy dalsze perspektywy definiowania, czym jest "agent". W sensie przetwarzania rozproszonego agenty są autonomicznymi procesami programowymi lub wątkami, w których waŋne są atrybuty mobilnoķci i autonomii. W rozumieniu agentów internetowych, pojęcie agencja jest kryterium nadrzędnym, tj. agenci dziaģają w imieniu kogoķ (tak jak robi to biuro podróŋy, udzielając pomocy w organizowaniu podróŋy w naszym imieniu, gdy nie mamy wiedzy, ani ochoty, ani czasu, aby to zrobiæ sami ). W symulacji i modelowaniu model oparty na agentach (ABM) to model obliczeniowy, którego celem jest symulacja dziaģaņ i interakcji autonomicznych jednostek w sieci lub ķrodowisku, a tym samym ocena ich wpģywu na system jako caģoķæ

Projektowanie zorientowane na agenta a projektowanie zorientowane na obiekt

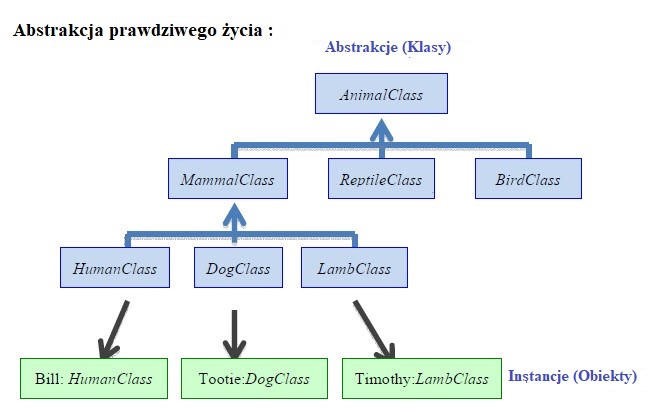

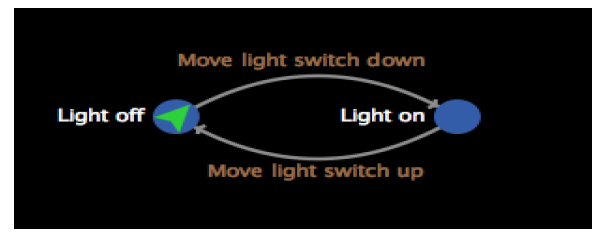

Czym róŋni się projektowanie zorientowane na agentów od projektowania obiektowego? Aby odpowiedzieæ na to pytanie, najpierw musimy zbadaæ, co to znaczy, aby projekt systemu byģ zorientowany obiektowo. Programowanie obiektowe (OOP) jest obecnie gģównym paradygmatem programowania obsģugiwanym przez większoķæ języków programowania. "Obiekt" to encja oprogramowania, która jest abstrakcją osoby, miejsca lub rzeczy w realnym ķwiecie. Obiekty są zwykle powiązane z rzeczownikami, które pojawiają się w wymaganiach systemowych i są ogólnie definiowane przy uŋyciu klasy. Celem zajęæ jest scalenie wszystkich danych i procedur (zwanych "metodami") w jednym miejscu. Przedmiot skģada się z: toŋsamoķci, która pozwala na jednoznaczną identyfikację przedmiotu - na przykģad atrybuty takie jak imię i nazwisko, data urodzenia, miejsce urodzenia mogą jednoznacznie identyfikowaæ osobę; stany, takie jak "door = open" lub "switch = on"; i zachowanie, takie jak "wyķlij wiadomoķæ" lub "otwarte drzwi" (są one powiązane z czasownikami

+ rzeczownikami w wymaganiach systemowych). Jakie wģaķciwoķci potrzebuje system, aby byģ zorientowany na obiekt? Niektóre definicje stwierdzają, ŋe tylko wymagane są abstrakcje i enkapsulacja wģaķciwoķci. Inne definicje stwierdzają, ŋe wymagane są równieŋ dalsze wģaķciwoķci: dziedziczenie, polimorfizm,

wiązanie dynamiczne i trwaģoķæ.

Opis : Wģaķciwoķci

Abstrakcja : Obiekty oprogramowania to wirtualne reprezentacje obiektów ķwiata rzeczywistego. Na przykģad klasa HumanClass moŋe byæ abstrakcją ludzi w prawdziwym ķwiecie. Moŋemy uwaŋaæ klasę za definiującą analogiczny związek między nią a ludžmi w prawdziwym ķwiecie.

Enkapsulacji : Obiekty obejmują wszystkie dane i metody związane z klasą, a dostęp do nich jest dozwolony tylko poprzez ķciķle wymuszony interfejs, który definiuje to, co jest widoczne dla innych klas,pozostaģa częķæ pozostaje ukryta (zwana "ukrywaniem informacji"). Na przykģad klasa HumanClass moŋe mieæ metodę talk (), której kod okreķla dokģadnie, co i jak mówiosiągnięty. Jednak kaŋdy, kto chce wykonaæ metodę talk () nie jest zainteresowany tym, w jaki sposób mówienie zostaģo osiągnięte.

Dziedziczenie : Projektant moŋe zdefiniowaæ podklasy, które są specjalizacjami klas nadrzędnych. Podklasy dziedziczą atrybuty i zachowanie swoich klas nadrzędnych, ale mają dodatkową funkcjonalnoķæ. Na przykģad HumanClass dziedziczy wģaķciwoķci swojej macierzystej MammalClass, która z kolei dziedziczy wģaķciwoķci od rodzica AnimalClass.

Polimorfizm : To dosģownie oznacza "wiele form". Metoda o tej samej nazwie zdefiniowana przez klasę nadrzędną moŋe przyjmowaæ róŋne formy podczas wykonywania w zaleŋnoķci od definicji podklasy. Na przykģad, MammalClass moŋe mieæ metodę talk () - spowoduje to wykonanie róŋnych procedur dlaobiekt naleŋący do HumanClass w porównaniu do obiektów naleŋących do DogClass lub LambClass (ten pierwszy moŋe zacząæ czatowaæ, podczas gdy drugi moŋe zacząæ szczekaæ lub beczeæ).

Dynamiczne wiązanie : Okreķla, która metoda jest wywoģywana w ķrodowisku wykonawczym. Na przykģad, jeķli d jest obiektem klasy DogClass, wtedy odpowiednia metoda do jej aktualnej klasy zostanie wywoģana w czasie wykonywania, gdy d.talk () jest wykonany. (Szczekanie zostanie stworzone zamiast czatowania lub beczenia).

Persistence : Obiekty i klasy obiektów pozostają, dopóki nie zostaną jawnie usunięte, nawet po ich zakoņczeniu wykonania.

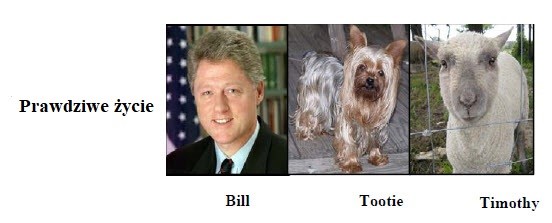

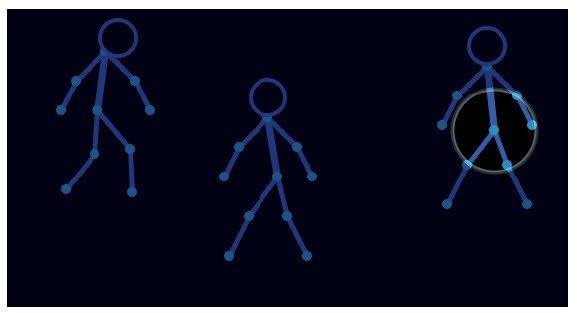

Rysunek poniŋszy ilustruje, w jaki sposób obiekty są abstrakcjami dla podmiotów w prawdziwym ŋyciu. Są przedstawione trzy obiekty - Bill, który jest instancją HumanClass, Tooty, który jest instancją klasy DogClass i Timothy, która jest instancją LambClass. (Obiekty są równieŋ nazywane "instancjami" danej klasy).

Czym róŋni się agent od obiektów? Wooldridge zapewnia następującą odpowiedž:

• Agenci mają większy stopieņ autonomii niŋ obiekty.

• Obiekty nie mają kontroli nad tym, kiedy są wykonywane, podczas gdy agenci decydują samodzielnie, czy wykonaæ jakąķ akcję. Innymi sģowy, obiekty wywoģują metody innych obiektów, podczas gdy agenty proszą innych agentów o wykonanie niektórych akcji.

• Agenci są zdolni do zachowania elastycznego (reaktywnego, proaktywnego, spoģecznego), podczas gdy obiekty nie okreķlają takich zachowaņ.

• System wieloagentowy jest z natury wielowątkowy - zakģada się, ŋe kaŋdy agent ma co najmniej jeden wątek kontroli.

Moŋemy przyjrzeæ się dwóm przykģadowym zadaniom, aby dokģadniej zilustrowaæ rozróŋnienie między agentami i obiektami: zadanie 1, czyszczenie podģogi w kuchni; i zadanie 2, pranie. Jakie są zorientowane na klienta i obiektowe rozwiązania tych dwóch zadaņ? Krótka odpowiedž brzmi, ŋe dla ŋadnego z zadaņ nie istnieje rozwiązanie caģkowicie obiektowe, poniewaŋ musimy uŋyæ agenta, aby wykonaæ zadania. W przypadku zadania 1 osoba czyszcząca podģogę moŋe byæ uwaŋana za przedstawiciela. W przypadku rozwiązania obiektowego tę osobę moŋna uznaæ za analogiczną do twórcy oprogramowania - podejmie on decyzje o tym, kiedy rozpocząæ czyszczenie, i wybierze odpowiednie narzędzia (przedmioty) oraz sposób ich uŋycia. Sam wybierze najbardziej odpowiednie ustawienia - odpowiadają one parametrom, które programista wybiera podczas pisania kodu (np. Stan, metody i argumenty przekazywane metodom). Niektóre przykģadowe obiekty to: miotģa - jej kierunek uŋycia, prędkoķæ i częstotliwoķæ przeciągnięæ; wiadro - ile wody, jej temperatura, rozmiar wiadra; lub odkurzacz - ustawienie mocy, ustawienie dywanu lub twardej posadzki, jej kierunek uŋytkowania i tak dalej. W przeciwieņstwie do tego, jednym z moŋliwych rozwiązaņ zorientowanych na agentów jest sprawienie, by robot wykonaģ zadanie - na przykģad zrobotyzowany odkurzacz (patrz zdjęcie po prawej). W przeciwieņstwie do rozwiązania obiektowego, robot dziaģa sam, a nie ktoķ inny. Sam decyduje, gdzie, kiedy i jak to zrobiæ. Na ryzyko antropomorfizacji, co jest oczywiķcie maszyną, moŋemy

wziąæ pod uwagę samego robota, który podejmuje decyzje, takie jak: "Nie muszę tego teraz robiæ - zrobię to jutro"; "Koņczą mi się moce - lepiej się ģaduję ponownie"; "Podģoga jest trochę brudna - lepiej ją zmoczyæ"; "Utknąģem - lepiej poprosiæ o pomoc". W przypadku zadania 2, obiektowe rozwiązanie polega na tym, aby czynnik ludzki uŋywaģ pralki do prania odzieŋy. Pralka ma wiele ustawieņ, które czģowiek moŋe wybraæ. W większoķci przypadków dosģownie nie wie, jak dziaģa pralka - jej dziaģania są ukryte przed nim. Po naciķnięciu przycisku start (to jest analogicznie do rozpoczęcia wykonywania kodu programu), pozostaje niewiele kontroli nad tym, co dzieje się póžniej. Obiekt pralki ma metody - na przykģad szybki cykl, cykl wirowania i tak dalej. Ma takŋe stan - na przykģad czas do zakoņczenia, temperaturę i tak dalej. W przeciwieņstwie do tego, czynniki ludzkie są jedynym rozwiązaniem zorientowanym na agent, dostępnym obecnie dla tego problemu. W przyszģoķci, robot domowy moŋe wykonaæ to zadanie dla ludzi. W tym przypadku z jego perspektywy moŋe podjąæ następujące decyzje: "teraz zrobię pranie dla ciebie"; "Ja sam zabiorę brudne ubrania"; "Teraz się doģaduję". Zwróæ uwagę, ŋe sģowa "ja" i "mnie" zostaģy wyróŋnione kursywą dla dwóch powyŋszych zadaņ. Ma to na celu podkreķlenie pierwszoosobowej perspektywy projektowej agenta - podejmuje decyzje z wģasnego osobistego punktu widzenia. Obiekty przeciwnie, są zaprojektowane z perspektywy trzeciej osoby, będąc przywoģywanymi zewnętrznie - wewnętrznie, nie ma pojęcia "ja". Programowanie i projektowanie obiektowe jest dominującym paradygmatem inŋynierii oprogramowania; kilka gģównych języków programowania obsģuguje obecnie programowanie zorientowane na agentów. Na przykģad Python jest wieloparadygmatem, ale nie obsģuguje programowania zorientowanego na agenta. Obecnie deweloper jest zmuszony uciekaæ się do hybrydowego projektu - za pomocą platform zorientowanych na agenta zaimplementowanych na platformie zorientowanej obiektowo. Róŋne struktury agentów omówiono w następnym rozdziale. W międzyczasie przyjrzymy się róŋnym rodzajom agentów, ich wģaķciwoķciom i rodzajom ķrodowisk, w których mogą one istnieæ.

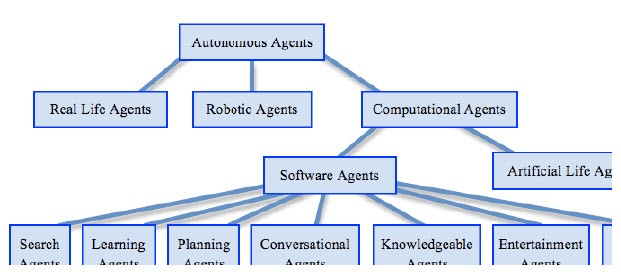

Taksonomia autonomicznych agentów

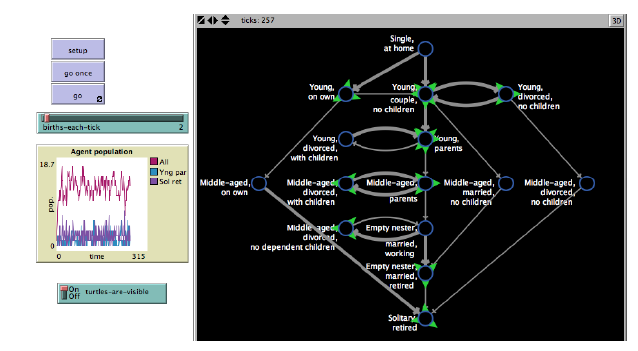

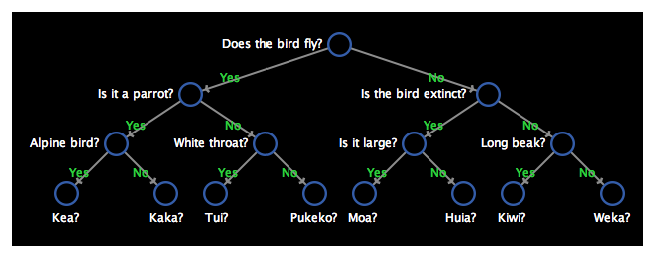

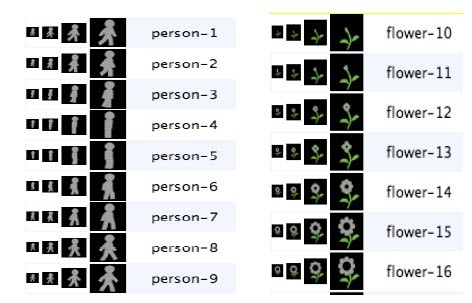

Powszechną metodą stosowaną w badaniach naukowych jest klasyfikowanie pojęæ w taksonomię. Często są one przydatne w tworzeniu struktury uģatwiającej organizację tematu dyskusji. Wiele przykģadów moŋna podzieliæ na wiele kategorii lub istnieją one między granicami dwóch powiązanych ze sobą pojęæ. Dlatego naleŋy ostroŋnie stosowaæ klasyfikację taksonomiczną. Rysunek pokazuje taksonomię autonomicznych agentów w oparciu o taksonomię zaproponowaną przez Franklina i Graessera (1998).

Biorąc pod uwagę powyŋsze komentarze na temat ograniczeņ klasyfikacji taksonomicznej, naleŋy podkreķliæ, ŋe nie jest to ostateczna lub wyczerpująca taksonomia. Dolny wiersz na poprzednim rysunku róŋni się od taksonomii Franklina i Graessera, która skģada się tylko z trzech podkategorii w kategorii "Agenci oprogramowania" - są to "Agenci specyficzni dla zadaņ", "Agenci rozrywki" i "Wirusy". Te ostatnie nie są uwzględnione - chociaŋ wirusy komputerowe są formą agenta, nie są dobroczynne (to jest,zwykle szkodliwe) i są lepiej traktowane jako osobny przedmiot. "Agent specyficzny dla zadaņ" zostaģ rozszerzony w celu dokģadniejszego zbadania poszczególnych zadaņ, takich jak przetwarzanie języka ludzkiego i zbieranie informacji. Zauwaŋ, ŋe ostatni wiersz nie jest w ŋadnym wypadku wyczerpujący - kolejne kategorie agentów obejmują wirtualnych ludzi, interakcje międzyludzkie, mobilne i wszechobecne czynniki. Inna kategoria agentów, o której często się mówi, to "Inteligentni agenci". Niestety, ten termin jest często naduŋywany. Często system jest oznaczony jako inteligentny agent z niewielkim uzasadnieniem, dlaczego jest "inteligentny". Ocena moŋe następnie polegaæ na pomiarze, jak dobrze agent wykonuje zadania, dla których zostaģ zaprojektowany. To, czy osiągi są wystarczające, aby agent zostaģ zaklasyfikowany jako "inteligentny", zaleŋy od obserwatora, który obserwuje wykonywane zadanie. Omówimy teraz kaŋdy z typów agentów, aby pomóc w wyjaķnieniu definicji. "Real Life Agents" oznacza ŋywe zwierzęta, takie jak ssaki, gady, ryby, ptaki, owady i tak dalej. Franklin i Graesser uŋyli terminu "agenci biologiczni" zamiast tej kategorii, ale moŋna to pomyliæ z czynnikami biologicznymi, którymi są toksyny, choroby zakažne (takie jak wirusy w prawdziwym ŋyciu; na przykģad Denga Fever i Ebola) i bakterii (takich jak Anthrax i Plague). "Sztuczni agenci ŋycia" to agenci, którzy tworzą sztuczną formę ŋycia lub symulują prawdziwą istotę ŋyciową. Robotyczne mechanizmy mechaniczne (zamiast robotów programistycznych) są równieŋ agentami z punktu widzenia sztucznej inteligencji - na przykģad roboty uŋywane do misji Mars Rover, takie jak Spirit i Opportunity, dziaģają jako "agenci" dla NASA na Marsie, ale mają takŋe pewien stopieņ autonomii, aby dziaģaæ samodzielnie. Agenci oprogramowania, którzy istnieją wyģącznie w ķrodowisku wirtualnym lub opartym na oprogramowaniu. Moŋna je podzieliæ na wiele róŋnych kategorii - na przykģad agentów przetwarzających język ludzki, agentów zbierających informacje, agentów posiadających wiedzę, agentów, którzy uczą się i agentów przeznaczonych do celów rozrywkowych, takich jak uŋywane w grach komputerowych i na specjalne potrzeby efekty w filmach. "Human Agents" naturalnie naleŋą do kategorii "Real Life Agents". Murch i Johnson (1999) wskazują, ŋe obecnie ludzie są agentami, którzy są najlepsi w wykonywaniu najbardziej zģoŋonych zadaņ na ķwiecie i będą tak przez jakiķ czas. Ludzie agenci o specjalistycznych umiejętnoķciach (np. biuro podróŋy lub agent piģki noŋnej lub gwiazda filmowa) ķwiadczą usģugi w imieniu innych ludzi, którzy nie byliby w stanie uzyskaæ tej usģugi w inny sposób, lub którzy nie mają czas lub umiejętnoķci, aby zrobiæ to samemu. Mają kontakty, aby ķwiadczyæ tę usģugę, mają dostęp do odpowiednich informacji i często mogą ķwiadczyæ tę usģugę za uģamek kosztów. Jednak ludzie są ograniczeni liczbą godzin pracy w tygodniu; w ciągu 12 godzin mogą pracowaæ maksymalnie 84 godziny w tygodniu, a przy tym szybko wypalą! Dlatego istnieje moŋliwoķæ, aby agenci komputerowi mogli nam przezwycięŋyæ te ograniczenia. Próbując sklasyfikowaæ, czym jest agent, moŋemy równieŋ zadaæ przeciwne pytanie - "Czym nie są agenci?" Nwana (1996) zauwaŋyģ, ŋe Minsky w swojej ksiąŋce "Towarzystwo Umysģu" uŋyģ tego terminu do sformuģowania swojej teorii ludzkiej inteligencji:

…aby wyjaķniæ umysģ, musimy pokazaæ, jak umysģy są budowane z bezmyķlnych rzeczy, z częķci, które są znacznie mniejsze i prostsze niŋ wszystko, co uwaŋalibyķmy za mądre …Ale jakie mogģyby byæ te prostsze cząstki -" agenci ", którzy tworzą nasz umysģy? To jest temat naszej ksiąŋki… " (Minsky)

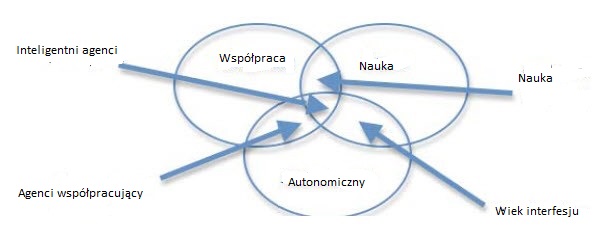

Nazwa definiuje agentów w taki sposób, ŋe pojęcie Minsky′ego o agencie nie speģnia jej kryteriów. Uŋywa trzech minimalnych cech, by wyprowadziæ cztery typy agentów w oparciu o typologię pokazaną na poniŋszym rysunku : wspóģpracujący agent, wspóģpracujący agent uczący się, agenci interfejsu i prawdziwi inteligentni agenci. Ta ostatnia rozszerza tę listę, aby uwzględniæ trzy dalsze typy: agentów informacji / Internetu, agentów reaktywnych i agentów hybrydowych

Jej definicja mówi, ŋe agenci dziaģają bardziej na poziomie wiedzy niŋ na poziomie symboli i wymagają "komunikacji na wysokim poziomie" [jej sģów] (w przeciwieņstwie do "komunikatów niskiego poziomu" uŋywanych w systemach rozproszonych). Dlatego agenci Minsky′ego, systemy eksperckie, większoķæ opartych na wiedzy aplikacji systemowych i moduģy w aplikacjach rozproszonych nie kwalifikują się. Ani agenci ŋóģwi nie uŋywali języka programowania NetLogo, języka zaprojektowanego po jej opublikowaniu. Termin proto-agent jest często uŋywany w modelowaniu agentów i symulacji w celu objęcia agentów "niŋszego poziomu", takich jak agenci ŋóģwi w NetLogo, aby odróŋniæ je od agentów, do których naleŋą. Slniejsze definicje, takie jak Nwana. Póģnoc i Macal definiują proto-agenta jako jednostkę uŋywaną w modelowaniu i symulacji, która zachowuje zestaw wģaķciwoķci i zachowaņ, które nie muszą wykazywaæ zachowania uczenia się. Jeķli uzyskają oni zdolnoķæ uczenia się, stają się agentami. Do celów tych ksiąŋek, zamiast dokonywania arbitralnego rozróŋnienia między proto-agentem i agenta, uwaŋamy, ŋe wszystkie powyŋsze przykģady mają pewien stopieņ agresywnoķci zdefiniowany w podrozdziale 2.1. Dlatego uŋyjemy terminu agent zamiast raczej proto-agenta, poniewaŋ w rzeczywistoķci obecnie nie istnieje ŋaden system zorientowany na agenta, który osiągnąģ jeszcze peģny zestaw wģaķciwoķci zgodnie z definicją Nwana lub zestaw poŋądanych wģaķciwoķci opisanych bardziej szczegóģowo w następnym dokumencie.

Poŋądane wģaķciwoķci agentów

Pojęcie agenta moŋna zdefiniowaæ, wyszczególniając poŋądane wģaķciwoķci, które chcemy wystawiaæ agentom. Russell i Norvig zidentyfikowali pierwsze cztery wģaķciwoķci w tabeli jako kluczowe atrybuty agenta z perspektywy sztucznej inteligencji: autonomię (dziaģanie we wģasnym imieniu bez interwencji); reaktywnoķæ (reagowanie na bodžce); proaktywnoķæ (bycie proaktywnym); i zdolnoķci spoģeczne (w stanie komunikowaæ się w jakiķ sposób z innymi agentami). Autonomia jest w szczególnoķci waŋną kluczową cechą - w rzeczywistoķci termin "niezaleŋni agenci" jest często uŋywany w literaturze jako synonim systemów zorientowanych na agenta, aby podkreķliæ ten punkt. Szeķæ wģaķciwoķci w Tabeli 2 często okreķla się jako naleŋące do sģabego agenta, dodając zdolnoķæ do wyznaczania celów i ciągģoķci czasowej jako dwa dalsze kluczowe atrybuty. Wģaķciwoķci w tabeli 3 są związane z silnym pojęciem ķrodka, poniewaŋ są to wģaķciwoķci zwykle stosowane u ludzi. Taskin i in. wymieņ trzy dalsze wģaķciwoķci w tabeli , które są kombinacjami podstawowych wģaķciwoķci: koordynacja, umiejętnoķæ wspóģpracy i zdolnoķæ planowania.

Wģaķciwoķæ : Opis

Autonomia : Agent sprawuje kontrolę nad wģasnymi dziaģaniami; dziaģa asynchronicznie.

Reaktywnoķæ : Agent reaguje w odpowiednim czasie na zmiany w ķrodowisku i sam decyduje o tym kiedy dziaģaæ.

Proaktywnoķæ : Agent reaguje w najlepszy moŋliwy sposób na moŋliwe przyszģe dziaģania, które są oczekiwane zdarzyæ.

Zdolnoķci spoģeczne (Zdolnoķæ do porozumienia się) : Agent ma moŋliwoķæ komunikowania się w sposób zģoŋony z innymi agentami, w tym ludzi, w celu uzyskania informacji lub uzyskania pomocy w osiąganiu celów.

Umiejętnoķæ wyznaczania celów : Agent ma cel.